0 引言

合成孔径雷达(Synthetic Aperture Radar,SAR)对地面建筑与人造桥梁都比较敏感,成像原理为主动式微波反射成像,SAR具有更多细节表现信息和纹理特征;与此同时,SAR不受气候环境干扰,能全天成像接收更多的地理信息。可见光图像(Visible image)成像需要依赖发光源,原理为光反射成像,能很好地体现出地表的光谱信息、地面物的物理属性[1]。两者对比,SAR的优势在于能体现出更多的细节特征,但却易受地物的特性干扰,也没有目视观测能力、地物直视能力;Visible image的优势在于具备直视效果、目标解译能力,但若成像条件不好,则已丢失地物细节特征。将SAR与Visible image融合的目标在于使得遥感影像同时具备更多的细节特征、目标直视解译能力,融合两种图像的优点[2]。与传统的多光谱、全色遥感影像融合相比,SAR与Visible image兼顾地物光谱信息与细节特征,且SAR有抗干扰能力较强的特性[3]。故使SAR和Visible image做有效融合,可获得一幅同时具备高空间、高细节、高光谱的遥感影像,其更具有可视性,在实际应用中例如军事侦测、农业规划、目标提取等图像处理工作提供了更多的有效信息。

近年来,多尺度分析法跟主成分替换法为在SAR与可见光图像的融合领域被广泛得到应用。多尺度分析法中NSST变换不仅具有传统Con- tourlet 变换的局部化特性等优点,且具备更高效的计算能力、拥有平移不变性,同时能减小伪吉布斯现象,因此NSST变换在图像融合领域获得了显著的优势[4],可通过NSST变换后的图像低频分量体现的是其近视特性,近视值大都达不到标准指标,图像的低频信息无法较好体现出本身特征。主成分替换法中IHS变换是让Visible image经IHS分离出的I分量被SAR经对比度拉伸之后替换,将亮度、光谱两种信息分开,使融合图像保持良好的光谱信息,但缺点在于融合的过程只在像素间发生,较易产生频谱混叠的情况,无法同时兼备融合图像的细节表现。脉冲耦合神经网络(PCNN)具备耦合跟同步脉冲的优点,与此同时图像信息经过PCNN模型处理,可以使得最终结果保留更多细节信息,提高所得图像的质量[5]。

针对以上算法一些不足之处,根据NSST算法计算力高效,具有平移不变性、IHS变换可以较好地分开Visible image的光谱、亮度两种信息,PCNN模型能使得目标图像保持更多细节信息等长处,本文提出一种NSST-IHS结合PCNN模型的改进融合算法。本文算法提升了SAR与Visible image的融合质量、各类评价指标、最终融合图的光谱信息,线性结构特征更多地保留下来。

1 算法原理

1.1 PCNN模型与NSST变换

1.1.1 PCNN模型

PCNN模型是一种旨在模拟猩猩等动物的脑部视觉皮层神经元,类似于一种动物处理视觉信息的过程,此模型由 Eckhorn等[6]提出,复杂的参数设计,会某个程度上阻碍PCNN模型的应用,本文采取简化的PCNN模型,方程描述如下:

Amn(t)=Bmn(t)

(1)

Cmn(t)=exp(-αC)Cmn(t-1)+

(2)

Zmn(t)Amn(t)×(1+β Cmn(t))

(3)

θmn(t)=exp(-αθ)θmn(t-1)+

VθYmn(t-1)

(4)

(5)

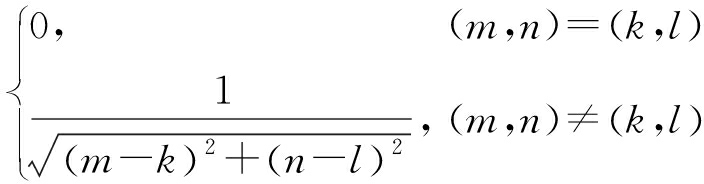

式中:下标(m,n) 为神经元的坐标;t为迭代次数;k,l为神经元的链接区间;Tmn 为外部激励;Amn 为反馈输入; β为链接强度因子; Zmn为内部活动项;Cmn 为链接输入; Wmn,kl为伴随着Cmn的突触权矩阵系数,而Zmn则是β使得Cmn 与Amn共同结合得到;VC,Vθ,αθ和αC 分别为振幅收益系数、放大系数、衰减时间常数、时间衰减系数。Wmn,kl 的计算方程描述如下:

Wmn,kl=

(6)

θmn是动态阈值,此数值根据上一个状态θmn 与输出结果Ymn 而得到。如果Zmn(t)≥θmn(t),称为一次点火,又称神经元生成1个脉冲。

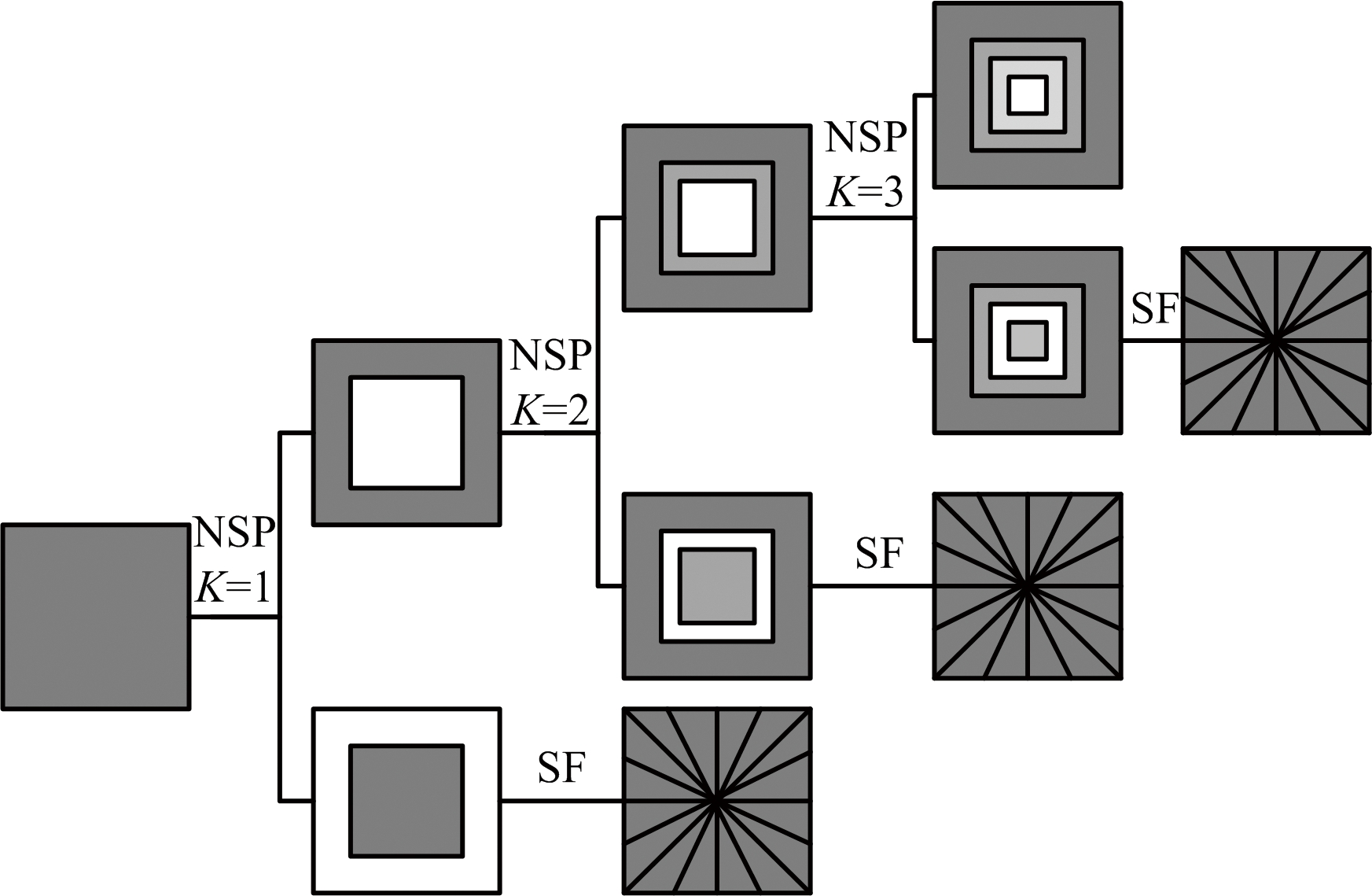

1.1.2 NSST变换原理

非下采样金字塔(Non Subsampled Pyramid,NSP)滤波组的多尺度分解、基于改进的剪切波滤波器组(Shearlet Filter,SF)的多方向分解为NSST离散化过程的两个主要部分。图像通过NSST变换,得到一幅低频与多幅高频跟原图像大小相同的图像。变换所得低频图像与原图十分近似,所得高频图像其中大部分含有原图的细节特征,故选取较好的融合规则对融合的结果有很关键的作用。NSST离散原理图如图1所示。

图1 NSST离散原理过程图

1.2 改进的融合算法

1.2.1 低频子带分量融合规则

低频子带分量融合采取基于PCNN模型的自适应融合方法,重点在于此模型Tmn 与β数值的确定。空间频率可以很好地体现原图的细节特征,将区域空间频率当作PCNN的Tmn 值,以获得良好的融合效果。其中,水平方向、垂直方向及对角线方向是空间频率需要确定的计算,方程如下:

![]()

(7)

式中,OA为水平方向频率;PA为垂直方向频率;QHA为对角方向频率。下式中I、J是原图的行列数,P(i,j) 是原图经NSST分解在坐标(i,j) 的低频子带分量系数。

计算公式如下:

OA=![]()

(8)

PA=![]()

(9)

QHA=U+R

(10)

(11)

(12)

因图像像素的特征根据链接强度β来体现,同时β能直接影响链接通道在内部活动的比重。为加强融合图像的质量,本文采取以平均梯度为基础的指数衰减形式的办法[7]。本文以平均梯度为PCNN模型中的β值,图像的平均区域表达方程为

![]()

![]() ·

·

![]()

(13)

h1(m,n)=|M(m,n)-N(m+1,n)|

(14)

h2(m,n)=|M(m,n)-N(m,n+1)|

(15)

其中M×N表示区域大小,在此取3×3。以脉冲点火次数为根据来选择融合系数。融合规则表达如下:

![]()

(16)

式中,C1(m,n),Y1(m,n) 为Visible image通过NSST获得的低频子带系数、低频脉冲输出; C2(m,n),Y2(m,n)为SAR通过NSST获得的高频子带系数、高频脉冲输出;PF(m,n)则是最终融合图像的在坐标(m,n) 处的低频系数。

1.2.2 高频子带分量融合规则

高频分量本身就含有丰富的原图细节特征,故本文采取改进的拉普拉斯能量和(SML)融合规则[8],此融合与传统的空间频率、方差等相比,SML更加看重像素间在局部图像块区域中的相互的关联。改进的ML与SML方程如下:

XZef(p,q)=

![]()

(17) ![]()

式中:Eef(p,q)为在像素图像坐标(p,q)第f方向的系数,step为在系数间的可调整的变量。本文中的step值只为1。

![]()

(18)

窗口(2A+B)×(2A+B) 由上式中变量A和B共同决定。若Eef(p,q) 与![]() 是原SAR、Visible image与融合图像在对应像素上的系数,

是原SAR、Visible image与融合图像在对应像素上的系数,![]() 与

与![]() 是原SAR、Visible image同一像素上的拉普拉斯和。本文采用的SML融合规则方程:

是原SAR、Visible image同一像素上的拉普拉斯和。本文采用的SML融合规则方程:

![]()

(19)

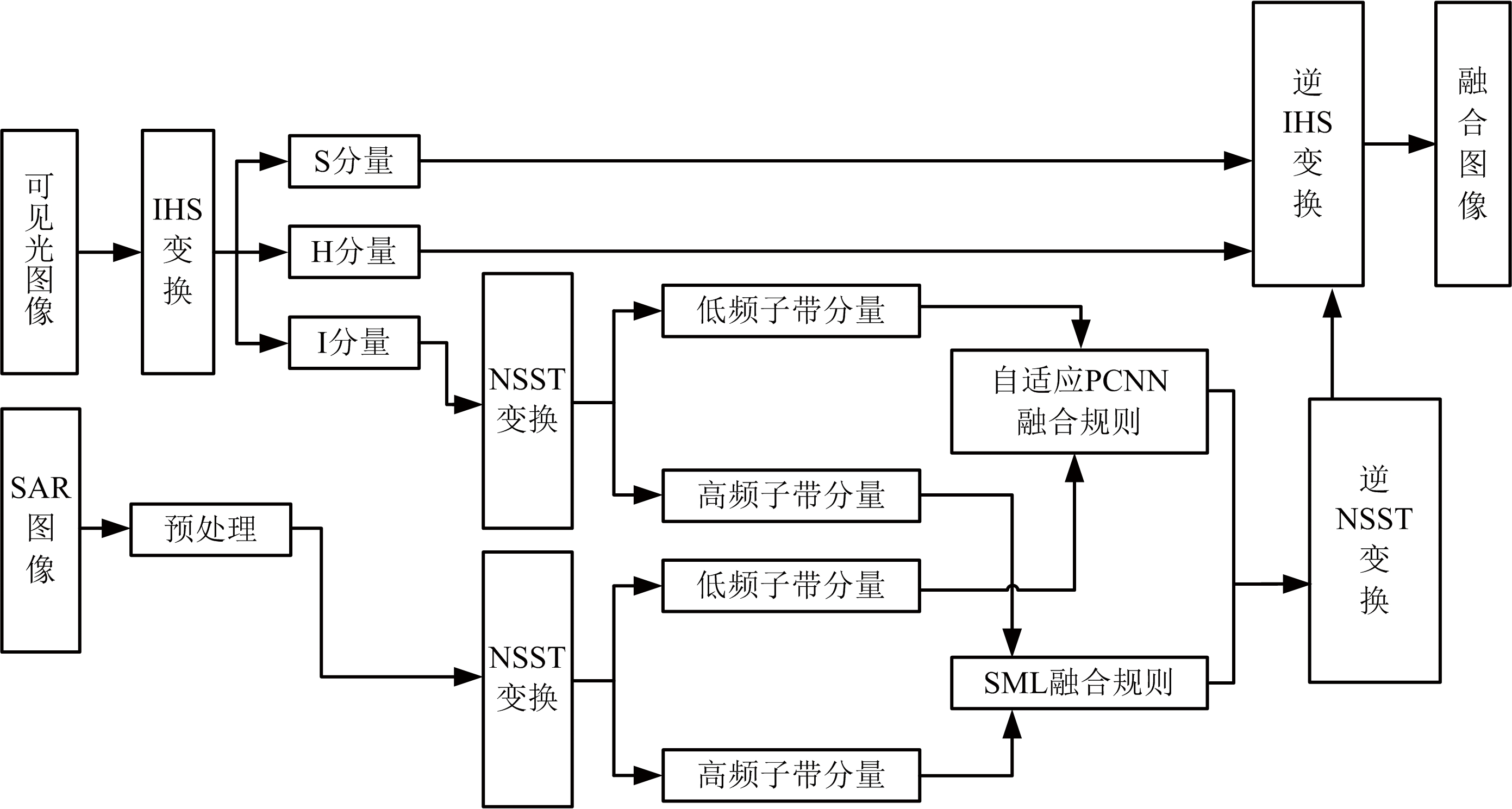

根据上述融合规则,本文算法融合步骤为首先对实验用图作预处理,对处理完的Visible image运用IHS、NSST,对SAR运用 NSST,获得相应的低频与高频子带分量;再将所得频与高频子带分量运用相应融合规则,得到相应的低频与高频子带融合分量,再分别运用逆NSST、IHS得到融合图像,融合流程如图2所示。

图2 NSST-IHS-PCNN算法流程

2 实验结果与分析

为验证本文所提出的算法优越及有效性,选用matlab2014对实验所用影像进行融合实验,影像区域选择天津渤海地区,SAR影像来源于欧盟“哨兵1号”(Sentinel-1)雷达卫星所属C波段图像,且SAR采用BM3D算法滤波[9],影像分辨率为5 m;Visible image来源于landsat-8,影像分辨率为30 m。同时选取基于IHS、NSCT、NSST变换以及NSST-IHS算法的融合实验结果进行对比分析。

在参数设计上,IHS变换的I分量波段权重系数设计为(0.3,0.75,0.25);NSCT变换的多尺度分解采取“maxflat”滤波器,方向滤波器采取 “dmaxflat7”,方向级数[1,2,3]; NSST、NSST-HIS及本文算法均采用“maxflat”滤 波 器。本文的PCNN模型参数如下:αC=1,αθ=0.2,(k,l)=(3,3),VC=1,Vθ=20,t=200。

2.1 实验结果

本文实验用图挑取的Visible image与SAR分别为图3(a)、(b),此区域包含很多建筑和水域,影像具有大量的光谱和线性结构特征信息。由图3(c)~(e)得知,IHS变换比NSCT、NSST整体颜色略浅,却未出现显著的光谱丢失,但线性结构特征等细节信息保留却没有另外两种方法好。由图3(d)~(f)得知,NSST-IHS变换相比于NSCT、NSST线性结构特征方面保留相差都不大,基本都包含原图像大部分的细节信息,但同时光谱信息保留也相对比NSCT、NSST稍好一些,可在图3(f)中河边建筑区域边缘上仍存在一些光谱失真现象,有略微的扭曲。图3(g)完全整合了图3(f)与前几种方法的优势,在所有融合图中最接近于图3(a)的直视感觉,图3(g)同时降低了3(f)出现的光谱失真,保留了更多的光谱信息,也将图3(b)中的线性结构特征更完好地保留,故综上所述,从各个方面来说,本文方法所得融合图质量最高。

图3 本文算法结果及对比算法结果

2.2 融合指标评价

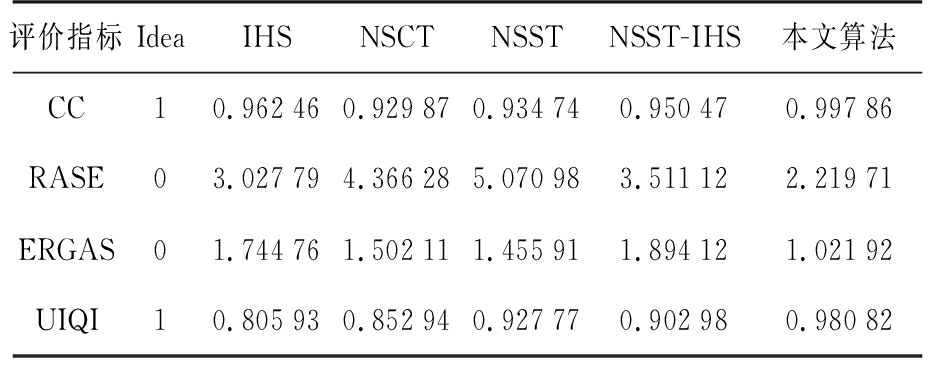

本文以文献[10]Wald质量评价指标为标准,因缺少具备高空间分辨率的Visible image作参照图像,SAR影像有扰乱地表目标解译的线性结构特征,若作为融合影像的空间细节对比图有较大差异,原可见光图像则在光谱信息与空间结构信息与融合图像最为相近,故选图3(a)作为融合图像的最终参照图像。实验数据结果以相关系数(Correlation Coefficient,CC)、相对平均光谱(Relative Average Spectral,RASE)、相对无量纲全局误差(ERGAS)、通用质量评价指标(Universal Image Quality Index,UIQI)四种指标来进行对比评价[10]。以上,CC、RASE用来评价表1是本文算法及对比算法所得融合图各项指标数据,由数据可知,IHS相比NSCT、NSST光谱评价指标(CC、RASE)较高;但在细节信息评价指标(ERGAS、 UIQI)上NSCT、NSST则比IHS变换要有优势;由此可得IHS有光谱信息保留能力,NSCT、NSST则拥有稍好线性细节特征保留能力。NSST-IHS与NSCT、NSST变换相比细节信息保留能力基本不变的同时,在光谱信息评价指标上也有提高。本文算法比较于其他四种变换,各类评价指标上都有明显的提高,说明本文算法改进效果明显。

表1 实验数据对比

评价指标IdeaIHSNSCTNSSTNSST-IHS本文算法CC10.962460.929870.934740.950470.99786RASE03.027794.366285.070983.511122.21971ERGAS01.744761.502111.455911.894121.02192UIQI10.805930.852940.927770.902980.98082

3 结束语

本文算法为一种改进的SAR与可见光图像融合算法,主要基于IHS、NSST、PCNN模型,与一些传统融合方法相比此算法同时具备保留更多光谱、线性细节特征两种信息。此算法主要针对低频子带分量采取结合PCNN模型的自适应融合规则,利用空间方向信息自动调整PCNN模型参数;高频子带分量采取SML融合规则。通过实验对比验证,本文算法有效提高融合图像的融合质量、视觉效果以及各类评价指标。

[1] BYUN Y. A Texture-Based Fusion Scheme to Integrate High-Resolution Satellite SAR and Optical Images [J]. Remote Sensing Letters,2014,5(2):103-111.

[2] 万剑华,臧金霞,刘善伟,等.一种全极化高分SAR与中分光学影像融合方法[J].热带海洋学报,2017,36(2):79-85.

[3] 梁怿清,王小华,陈立福.基于深度学习的SAR目标检测方法[J].雷达科学与技术,2019,17(5):579-586.

LIANG Yiqing,WANG Xiaohua,CHEN Lifu. Research on SAR Target Detection Method Based on Deep Learning[J]. Radar Science and Technology,2019,17(5):579-586.(in Chinese)

[4] 杨晟炜,张志华,孔玲君,等.基于NSST与IHS的红外与彩色可见光图像融合[J].包装工程,2019,40(11):194-202.

[5] IKUTA C,ZHANG S J,UWATE Y,et al. A Novel Fusion Algorithm for Visible and Infrared Image Using Non-Subsampled Contourlet Transform and Pulse- Coupled Neural Network[C]∥International Conference on Computer Vision Theory and Applications,Lisbon,Portugal:IEEE,2015:160-164.

[6] ECKHORN R,REITBOECK H,ARNDT M,et al.Feature Linking via Synchronization Among Distributed Assemblies: Simulations of Results from Cat Visual Cortex[J].Neural Computation,1990,2(3):293-307.

[7] 沈瑜,陈小朋,杨倩.多方向 Laplacian 能量和与 tetrolet 变换的图像融合[J].中国图象图形学报,2020,25(4):721-731.

[8] NAYAR S K,NAKAGAWA Y. Shape from Focus[J].IEEE Trans on Pattern Analysis and Machine Intelligence,1994,16(8):824-831.

[9] 孙越,黄国满,赵争,等.不同滤波方法的SAR与多光谱图像融合算法 [J].遥感信息,2019,34(4):114-120.

[10] WALD L,RANCHIN T,MANGOLINI M. Fusion of Satellite Images of Different Spatial Resolutions & Assessing the Quality of Resulting Images[J].Photogrammetric Engineering & Remote Sensing,1997,63(6):691-699.