0 引言

近年来,人类姿态的非接触式穿墙探测与分类技术在公共安全与防护、反恐作战、灾害救援等领域具有重要的应用价值,因此受到了广泛的研究关注[1]。通过对人体姿态的穿墙检测和识别,将有助于决策和制定救援策略,极大地提高救援效率和作战效能。与超声波、光学、红外线等传感器相比,基于雷达的特征提取与识别技术因其全天候的适应性和夜间的可用性而受到众多研究者的关注[2]。

目前,基于雷达的目标识别多采用距离像或微多普勒特征进行识别,而识别能力取决于特征提取和识别的方法,主要分为参数化和非参数化方法。典型的参数化方法就是从特征谱图中提取人工特征,采用机器学习进行识别,但是传统的机器学习需要分别进行特征提取和特征识别,工作量大又容易丢失谱图的深度信息。而非参数化方法则采用深度学习实现了特征提取和识别一体化,它直接识别目标的距离像或微多普勒特征谱图。利用步态的微多普勒特征谱图,文献[3]采用Capsule网络对跌倒进行检测,检测率可达 94.22%;而文献[4]将微多普勒数据分为实部和虚部两部分学习,采用基于Inception的网络进行训练,识别率可达96.9%。利用步态的高分辨率距离像,文献[5]使用超宽带雷达采集了7个动作的数据,通过3层卷积的神经网络训练测试,可得95.24%的识别率;文献[6]采用层数更多的神经网络对9种动作进行学习,可得96.67%的识别率。以上文献均没有摆脱传统训练网络中输入数据特征形式单一的局限性。为了利用人体姿态的各类特征,文献[7]构建了一种时间-距离像-微多普勒频率的三维特征形式,然后提出了一种主成分分析和浅层神经网络相结合的识别方法,识别率最高可达97.2%,但是由于数据结构复杂,导致以后的工作量较大,不利于人体姿态的实时识别。

针对上述问题,本文基于步进频连续波(SFCW)雷达体制,生成同一姿态的慢时间-距离像(Slow Time Range Map, STRM)和慢时间-微多普勒谱图(Slow Time Micro-Doppler Map, STDM)[8],然后提取STRM的幅值信息以及STDM的幅值信息和相位信息构建三维张量(3D-Tensor)的特征形式,在一定程度上扩展了人体姿态的特征维度。进一步,采取深度学习的方法进行目标识别,并在神经网络中引入了新型瓶颈残差模块(Improved Bottleneck Residual Module, IBRM),设计了一种改进型瓶颈残差神经网络(Improved Bottleneck Residual Neural Network, IBResNet)来实现人体的姿态识别,提高了识别的精确度以及运算效能。

1 三维张量数据集构建

假设SFCW雷达发射信号的起始频率为fo;Δf为步进的频率间隔;I表示一个慢时间内的频点总数,ΔT为每一个频点的持续时间;在一个慢时间Ts周期内,则发射信号可以表示为

sT(t)=![]()

exp{j2π(f0+iΔf)t}

(1)

式中,rect(·)表示矩形窗口函数。

对墙后人体进行探测时,回波信号中主要包括墙体强反射回波、人体目标的回波和周围的噪声,表示为

(2)

式中,K表示人体目标总的关节点数,Ak表示人体目标第k个关节点的回波强度,τk为第k个关节点双程回波延迟时间,swall(t)和snoise(t)分别表示墙体强反射回波和噪声信号。将sT(t)和sR(t)混频后,以采样间隔ΔT进行采样,并通过低频滤波器可得到某一个慢时间内基带回波采样序列。令第i个慢时间的记为

SR(i)=![]()

(3)

式中,Swall和Snoise分别表示为墙体和噪声的采样列向量,符号T表示转置。每列向量SR(i), i=1,2,…,N分别进行离散傅里叶反变换(Inversed Discrete Fourier Transform, IDFT)[9],可得每列向量对应的一维距离像回波信号为

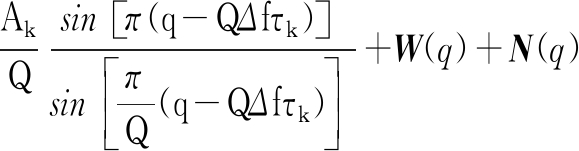

![]()

![]()

(4)

式中,q=1,2,…,Q,这里的Q表示IDFT的总点数,一般取为2的整数幂,且大于频点总数I,W(q)和N(q)分别表示为墙体和噪声的第q个快时间采样值,则可得到慢-快时间回波矩阵(Slow-Fast Time Echo Matrix ,SFEM),表示为

SSFEM=[Raw(1),Raw(2),…,Raw(N)]Q×N

(5)

式中,SSFEM为由N个慢时间所对应的一维距离向按时间流逝方向排列而成[9]。

采用时间窗置零法消除SSFEM中的墙体回波和天线耦合波。接下来采用线性趋势抑制(LTS)进一步消除回波中存在的静态杂波和线性趋势干扰,可得

SSTRM=SSFEM-SSFEMX(XTX)-1XT

(6)

式中,![]() 为N×1维的单位向量,(·)T表示共轭转置。

为N×1维的单位向量,(·)T表示共轭转置。

利用文献[10]中的方法提取STRM的有效通道范围,然后对每个有效通道分别进行短时傅里叶变换(STFT),最后在通道范围上累加可得

SSTDM=![]()

h(kΔt-mΔt)e-jknΔw

(7)

式中,M和L分别为有效通道的最小值和最大值,m和n分别为傅里叶点数和窗口滑动次数,Δt和Δw分别为采样的时间间隔和频率间隔,h表示时间宽度固定的窗函数,这里选取边缘相对平滑的海明窗以削弱回波信号中的旁瓣干扰。

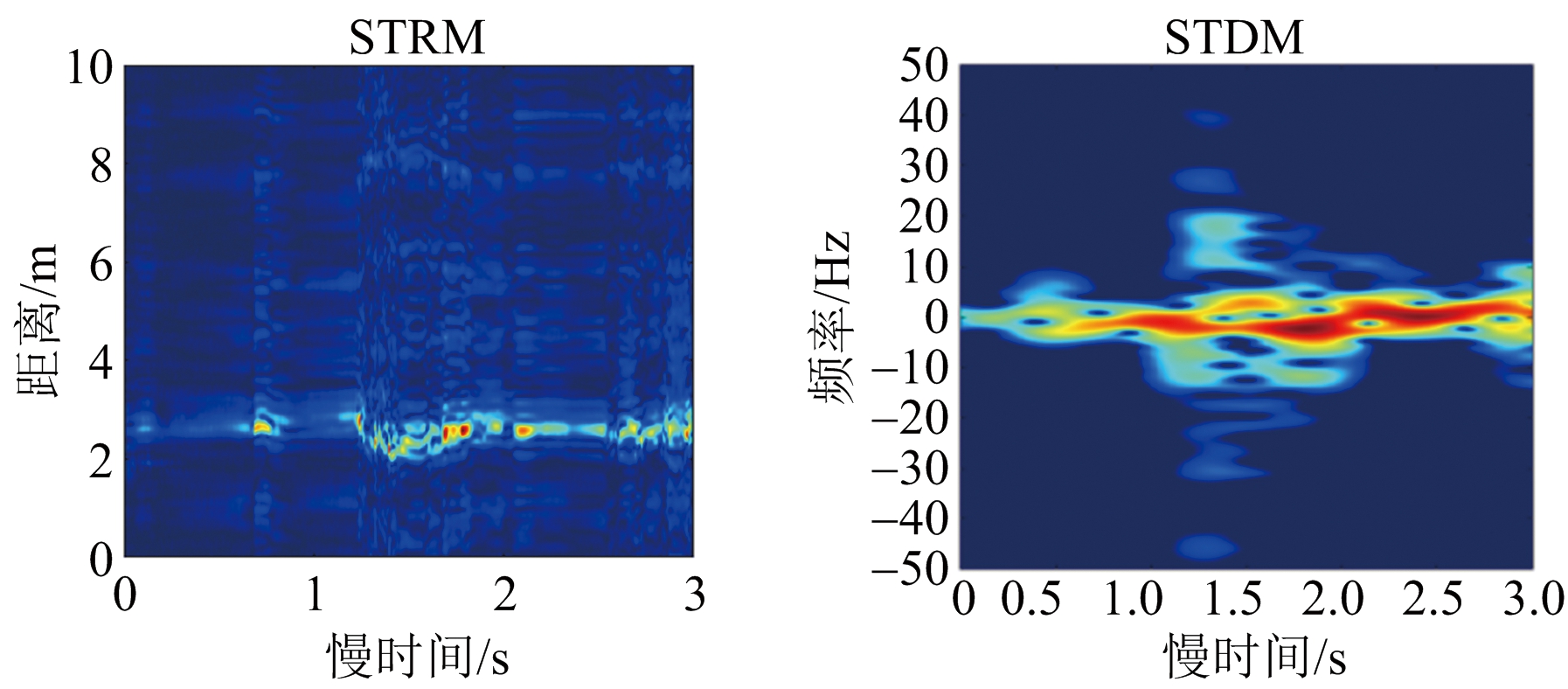

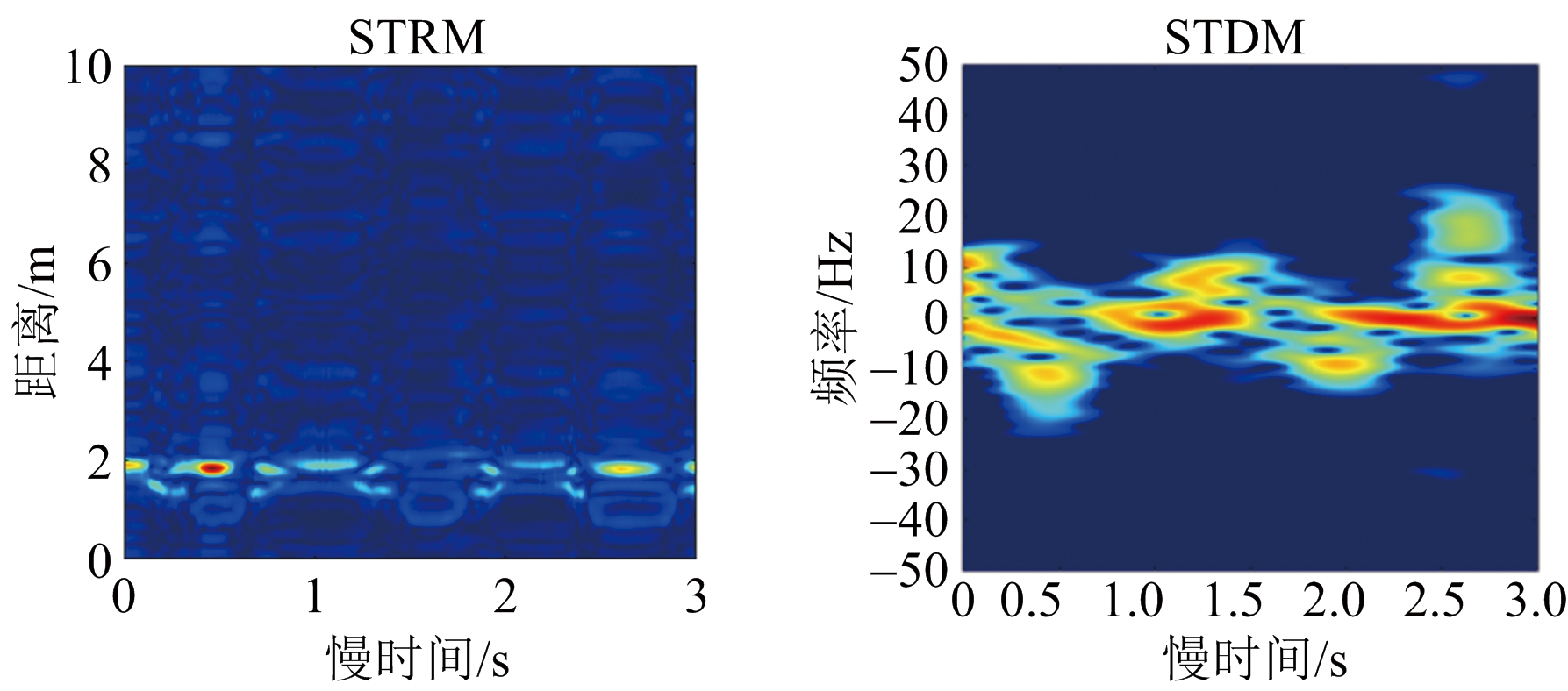

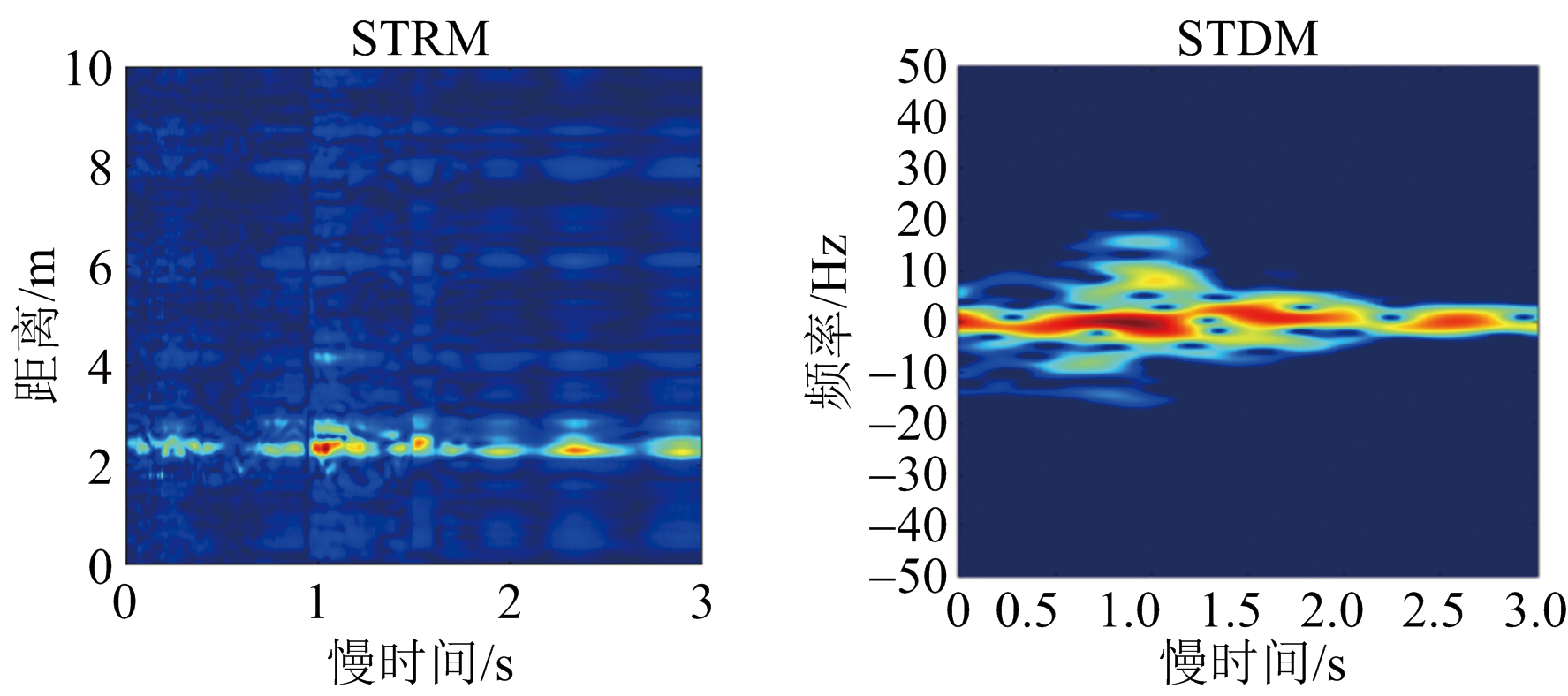

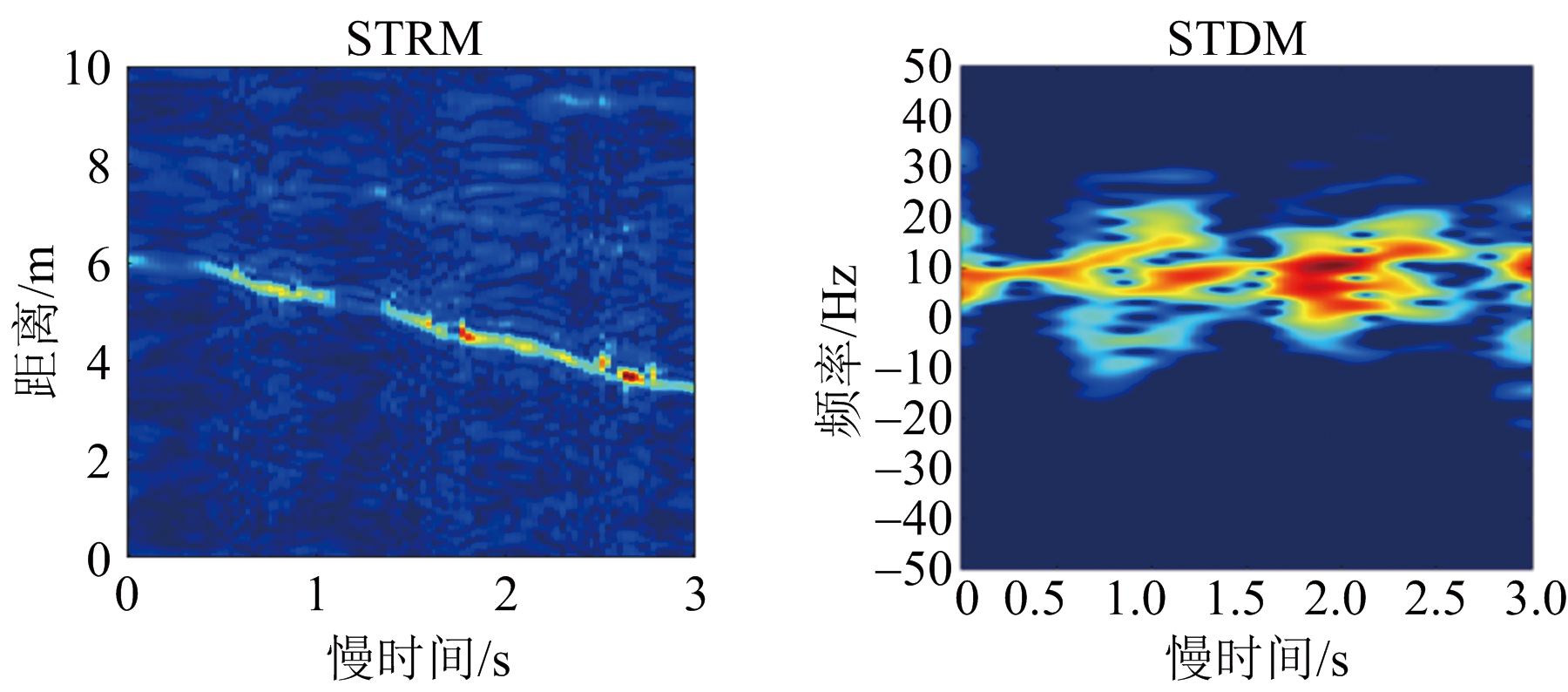

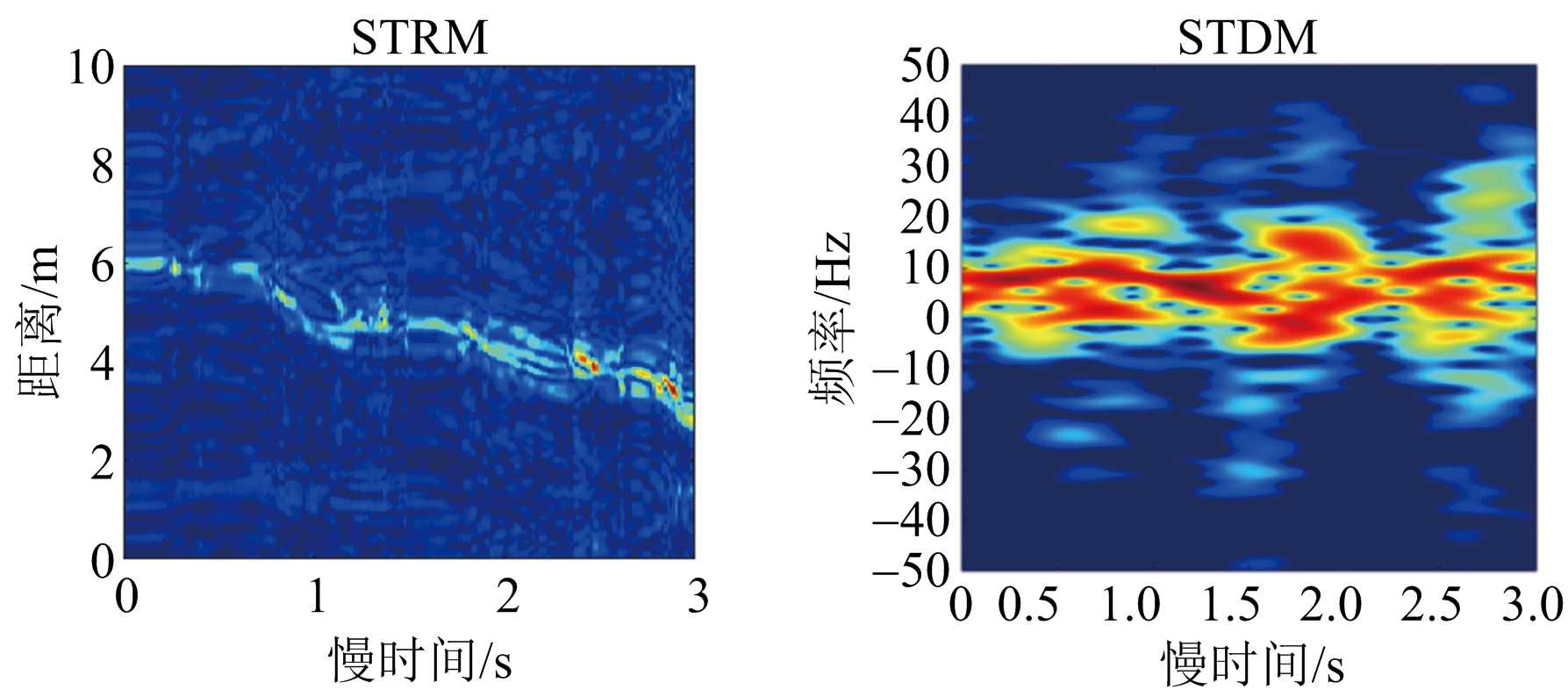

采用一组实测数据分析8种人体姿态的STRM和STDM,结果如图1所示。从图中可以看出:行走、小跑和正步走的STRM相似,STDM差异明显;而跳高和跳远的STDM相似,STRM差异明显;4种站立式运动的微多普勒特征相比于距离像更容易区分。所以,为了适用于多种姿态的精确识别,需要充分利用这两类特征数据。接下来,我们就构建了一个包含多普勒特征的幅值信息、相位信息和距离信息的三维张量(3D-Tensor)的数据结构。为了使数据集尺寸保持一致,将每个数据集尺寸均缩放为120×120,然后在第三层堆叠,3D-Tensor数据可表示为

3D-Tensor=Concat(3,STDM(幅值),

STDM(相位),STRM(幅值))

(8)

式中,Concat代表通道连接。其数据结构如图2所示,第一层为慢时间-多普勒特征的幅值信息,第二层为慢时间-多普勒特征的相位信息,第三层为慢时间-距离特征幅值信息。需要说明的是,第三层反映到特征图上也是实值图像,这里直接利用距离幅值并不会丢失原始信息。

(a) 跳高

(b) 挥拳

(c) 喝水

(d) 下蹲

(e) 小跑

(f) 步行

(g) 正步

(h) 跳远

图1 人体姿态的慢时间-距离像和慢时间-微多普勒谱图

图2 三维张量的数据结构

2 改进型瓶颈残差神经网络设计

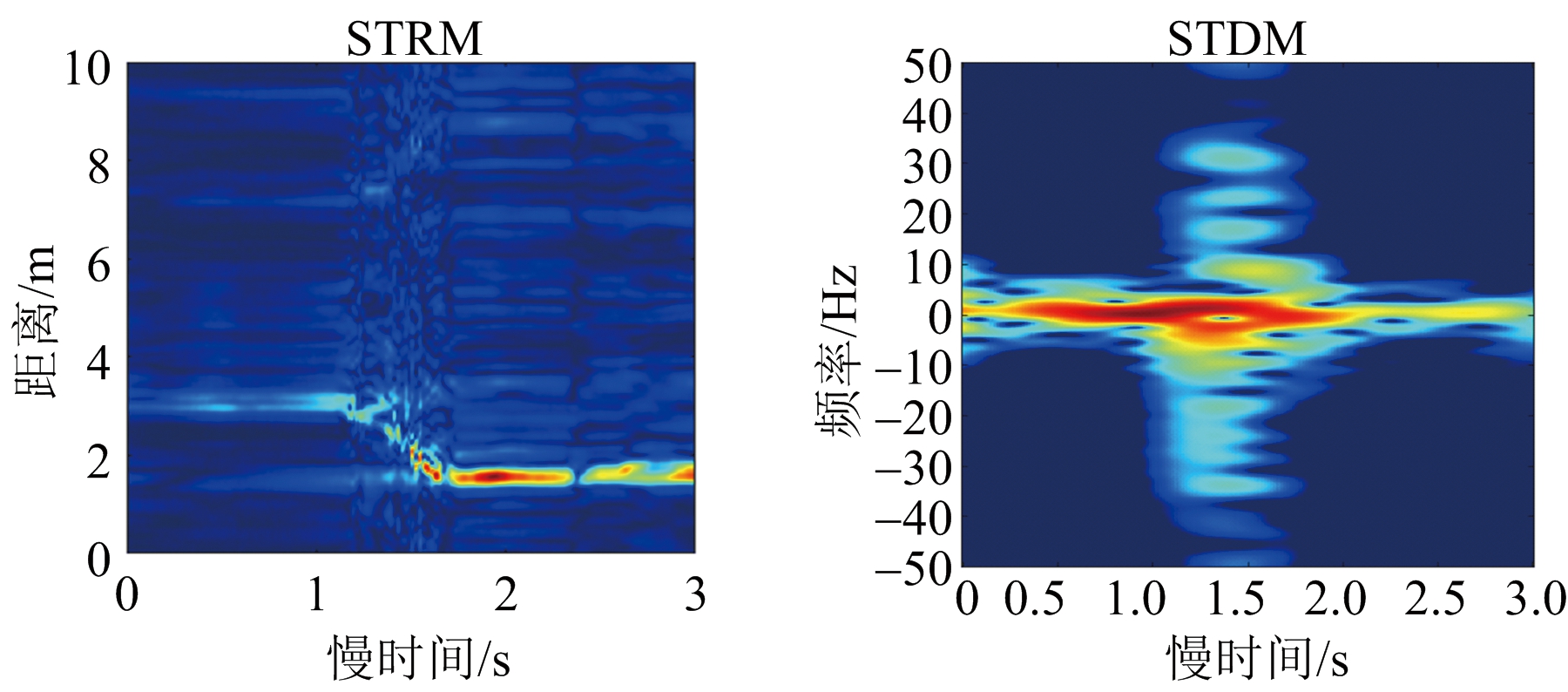

数据集构建完毕后,接下来设计神经网络对数据集进行训练。网络梯度是从后向前传播的,随着网络的加深,越靠前的层梯度会越小,这意味着靠前的某些层基本上学习停滞了,因此简单地去增加网络的深度反而会使优化问题更难,学习网络虽然收敛了,但出现了更高的训练误差。瓶颈残差模块中的跳跃连接可以有效地解决网络梯度退化的问题。然而,ResNet中的瓶颈残差模块,其性能低于适当加深的GoogLeNet[11],相比与GoogLeNet中的Inception模块,残差模块虽然网络深度足够,但宽度较窄,特征提取的多样性差于Inception模块。因此,从网络的宽度和深度两方面考虑,本文构建一种改进型瓶颈残差模块(Improved Bottleneck Residuals Module, IBRM)。

2.1 IBRM结构设计

IBRM是在瓶颈残差模块的基础上,通过引入并行连接的方式扩展网络的宽度,该结构分为模块1和模块2,如图3所示。模块前端采用4种不同的特征提取方式,然后把4组不同类型但大小相同的特征数据按通道堆叠起来,形成新的特征数据。一方面增加了网络的宽度,另一方面增加了网络对尺度的适应性;后接瓶颈残差模块中的跳跃连接,适当的增加网络深度,避免过拟合的情况。图中,每个卷积层后接了一个批次标准化层(Batch Normalization Layer, BN),该层是用于改善神经网络的性能和稳定性,激活函数为整流线性单元(ReLU);池化层采用最大池化;方框中(3×3@64,1)分别表示卷积核尺寸为3×3,卷积核数目为64,步长为1×1;深度连接层表示网络的并行连接;相加层表示相同位置处点加,即跳跃连接方式。

图3 改进型瓶颈残差模块

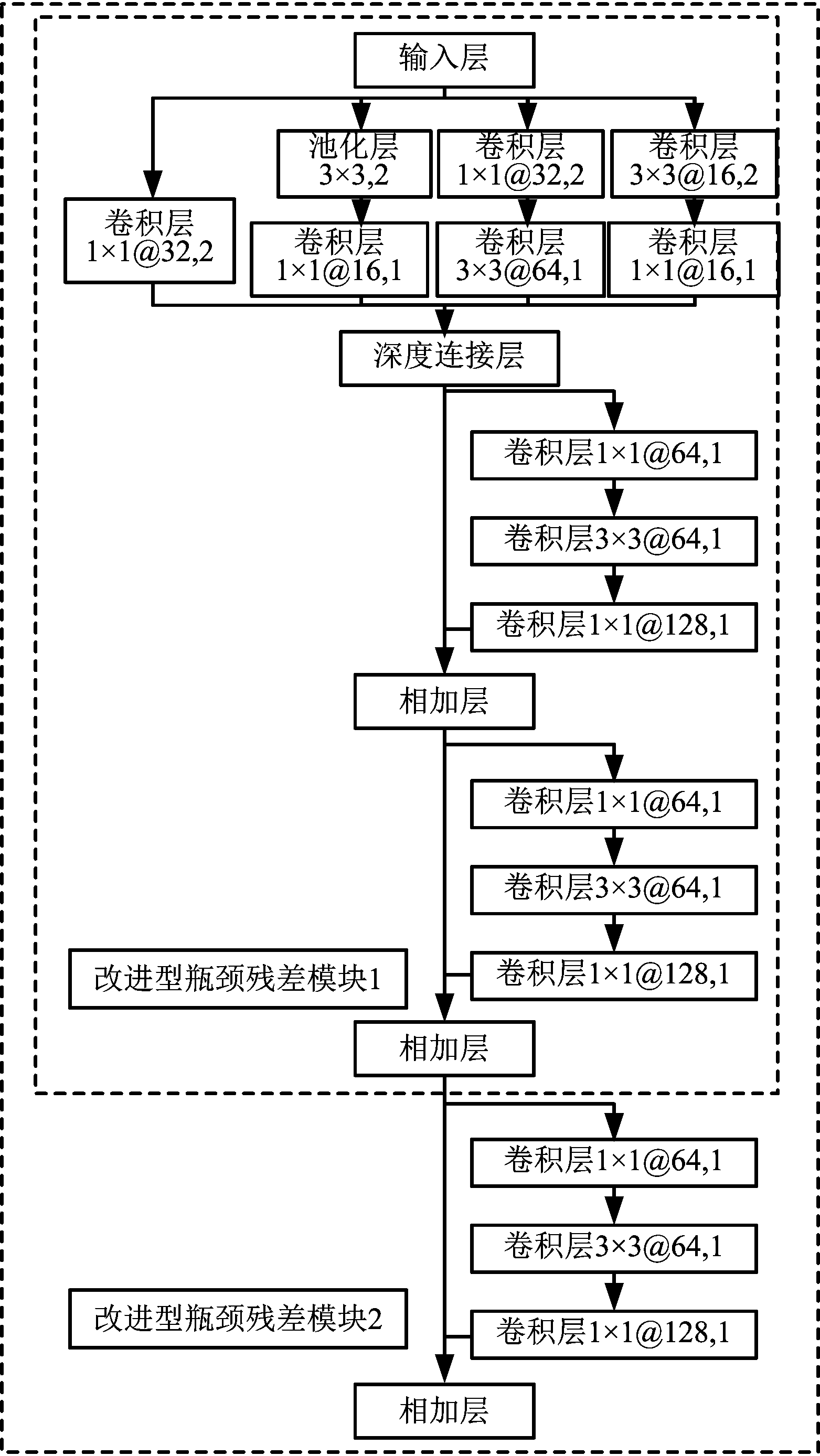

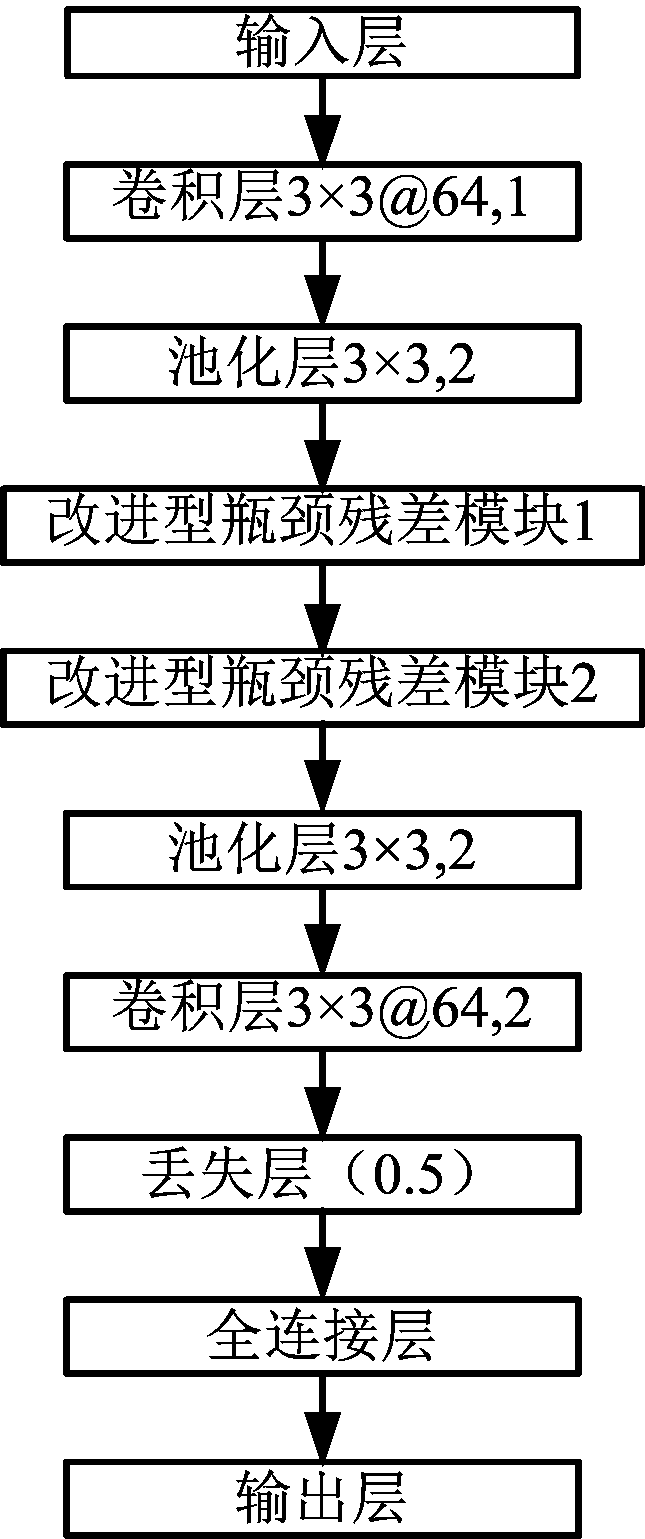

2.2 IBResNet结构

利用前面的模块1和模块2,结合现有的ResNet结构设计,IBResNet结构如图4所示。网络前端首先经过一个3×3@64卷积层,该层是扩展浅层特征,然后经过两个改进型瓶颈残差模块,其中模块2中的通道数是模块1中的2倍,主要是提取深度特征信息,最后分别接丢失层、全连接层和输出层,丢失层随机丢弃50%的连接,提高泛化能力,全连接层节点数为8,输出层的激活函数为Softmax,利用交叉熵损失函数来构造目标函数,表示为

![]()

log(softmax(φ(xn;W,b),θ))+

(9)

式中,W,b分别为各层的权值和偏差,NTR为一次迭代的训练集个数,xn,yn分别为训练数据和数据类别,θ为分类器的参数。

图4 改进型瓶颈残差神经网络

2.3 参数量和计算量分析

在IBResNet中,需要训练的参数量来自于卷积层、全连接层和BN,它们的参数量分别记为

(10)

式中,k为卷积核尺寸,N为卷积核数目,L为上一层的通道数,nin,nout分别为该全连接层的输入节点数和输出节点数。可以看出网络中的参数量主要来自于卷积层,因此,采用多个小尺寸卷积层替代一个大尺寸的卷积层具有更少的参数量,且非线性更多。

在网络训练过程中,池化层、BN、ReLU、Adittion等的计算量很小,主要的计算量来自于卷积层,一个卷积层的计算量记为

OP=![]()

(k2*L+1)*N

(11)

式中:H,W,L分别为该层输入数据的高、宽和通道数;Ph,Pw表示在高和宽方向的补零数目;S为卷积核的移动步长。由式(11)可知,计算量取决于该层的输入数据大小和卷积核的设置。

3 实验结果分析

3.1 实验环境

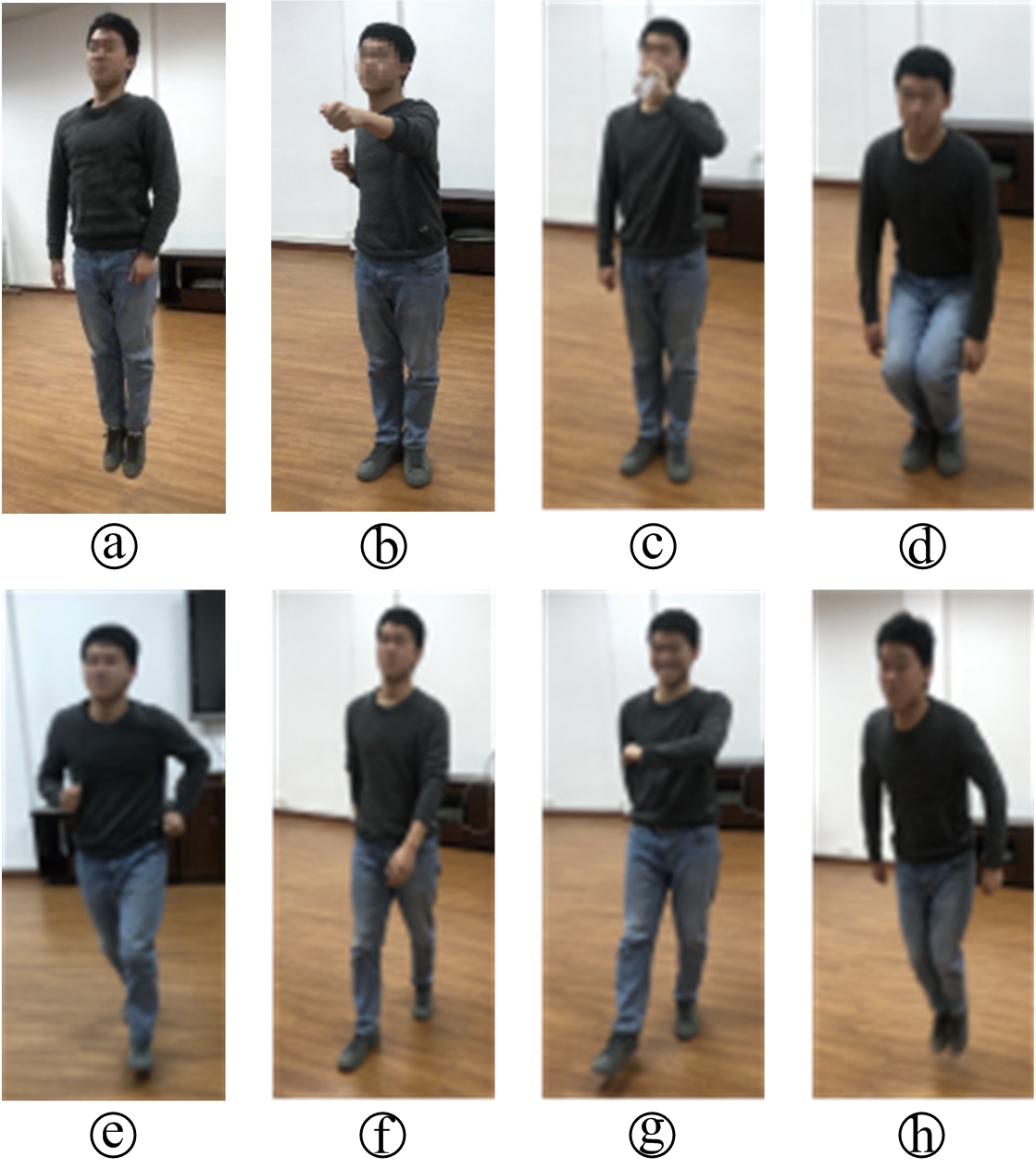

采用SFCW雷达系统,探测场景如图5(a)所示,发射信号的频率为 1~3 GHz,步进间隔为20 MHz,发射功率为10 dBm,扫描周期为 0.02 s;经测量墙体厚0.25 m,介电常数为 6.4。8种人体姿态如图5(b)所示,分别为 跳高、

跳高、 挥拳、

挥拳、 喝水、

喝水、 下蹲、

下蹲、 小跑、

小跑、 步行、

步行、 正步走、

正步走、 跳远,每种类型姿态包含了900个样本。

跳远,每种类型姿态包含了900个样本。

(a) 雷达系统场景探测

(b) 8种人体姿态

图5 实验环境

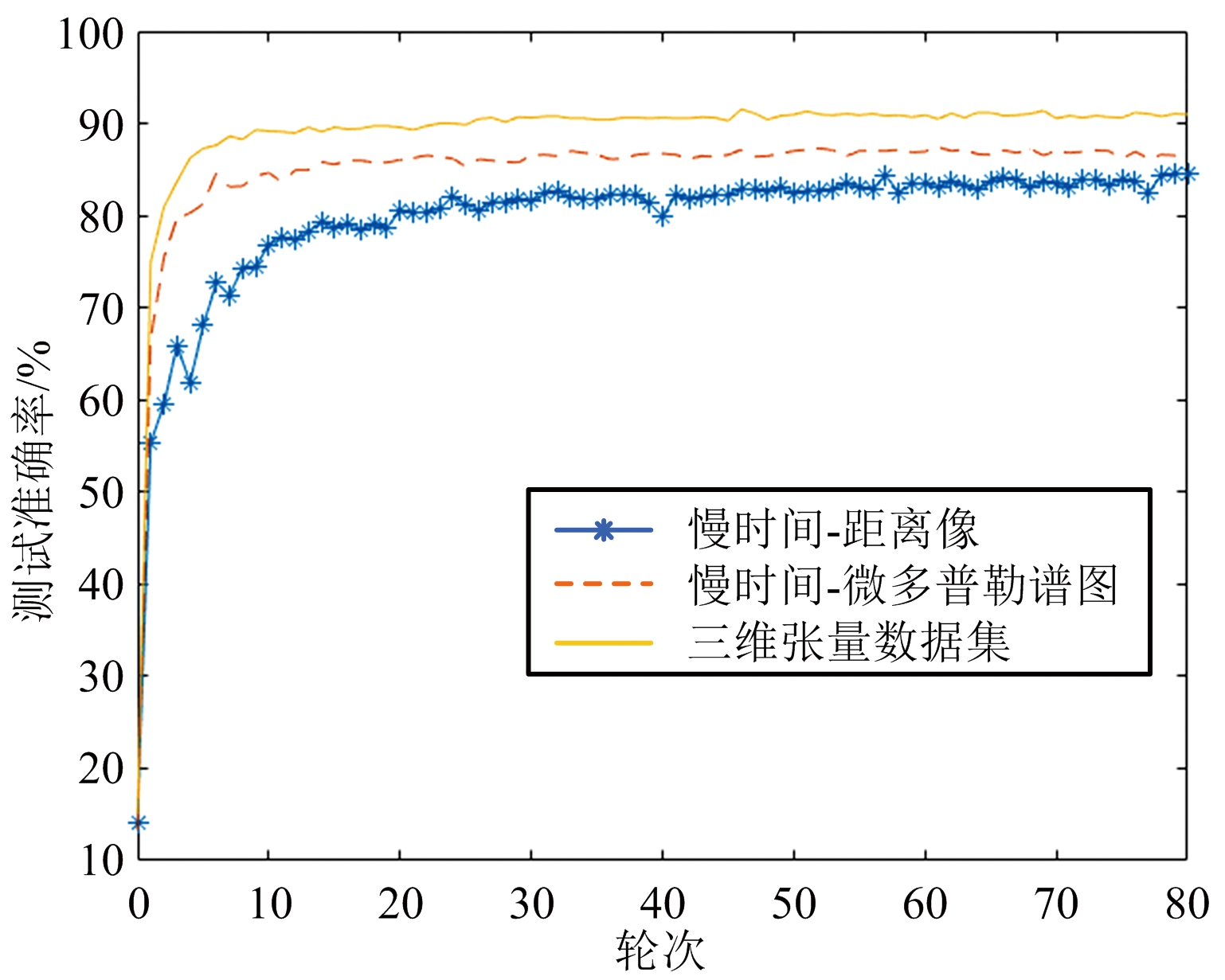

3.2 多维参数集验证

对STDM、STDM和3D-Tensor数据集分别进行网络训练,所采用的神经网络为文献[5]中的三层卷积神经网络(3-CNN),其卷积核分别为: 5×5@16、5×5@32、5×5@64。训练过程中,设置最大的训练轮次数为80,1个轮次表示遍历全部训练集一次。图6给出了这三种数据集的测试准确率曲线,测试结果从高到低依次为3D-Tensor、STDM、STRM。可以看出,相对于文献[5]中仅对距离像的识别,多维特征数据的识别准确率更高,且准确率曲线收敛的速度更快。

图6 不同数据集的测试准确率曲线

3.3 IBResNet参数寻优和验证

将3D-Tensor数据集按照7∶2∶1的比例划分为训练集、验证集和测试集[12]。采用的训练优化器为带一阶动量优化的随机梯度下降。网络训练过程中,采用周期机制来调整学习率,设置10个轮次更新一次学习率,记为

lr=lr0*(1-a)|Epoch=10

(12)

式中,lr0为初始学习率,a为学习衰减率。

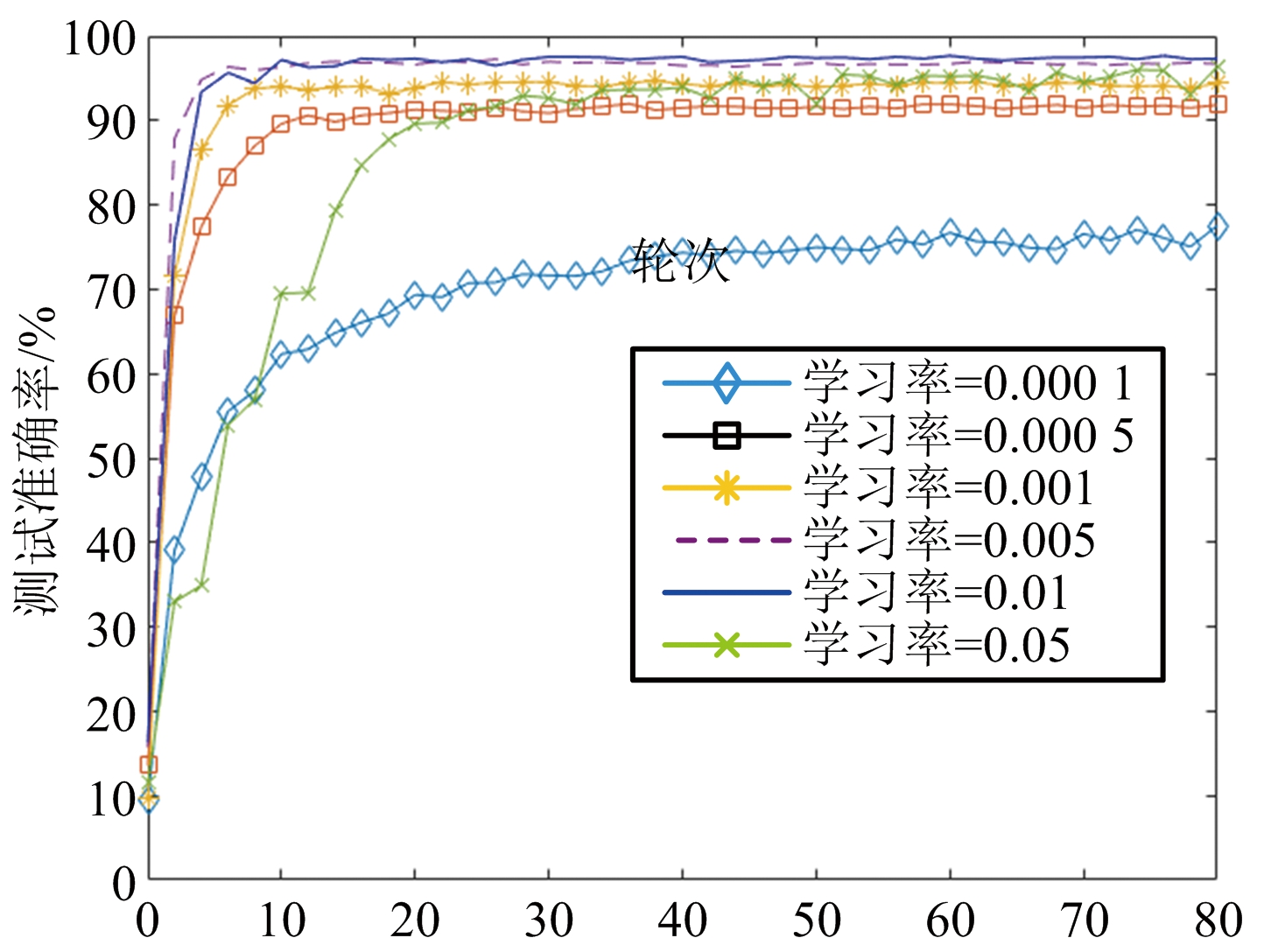

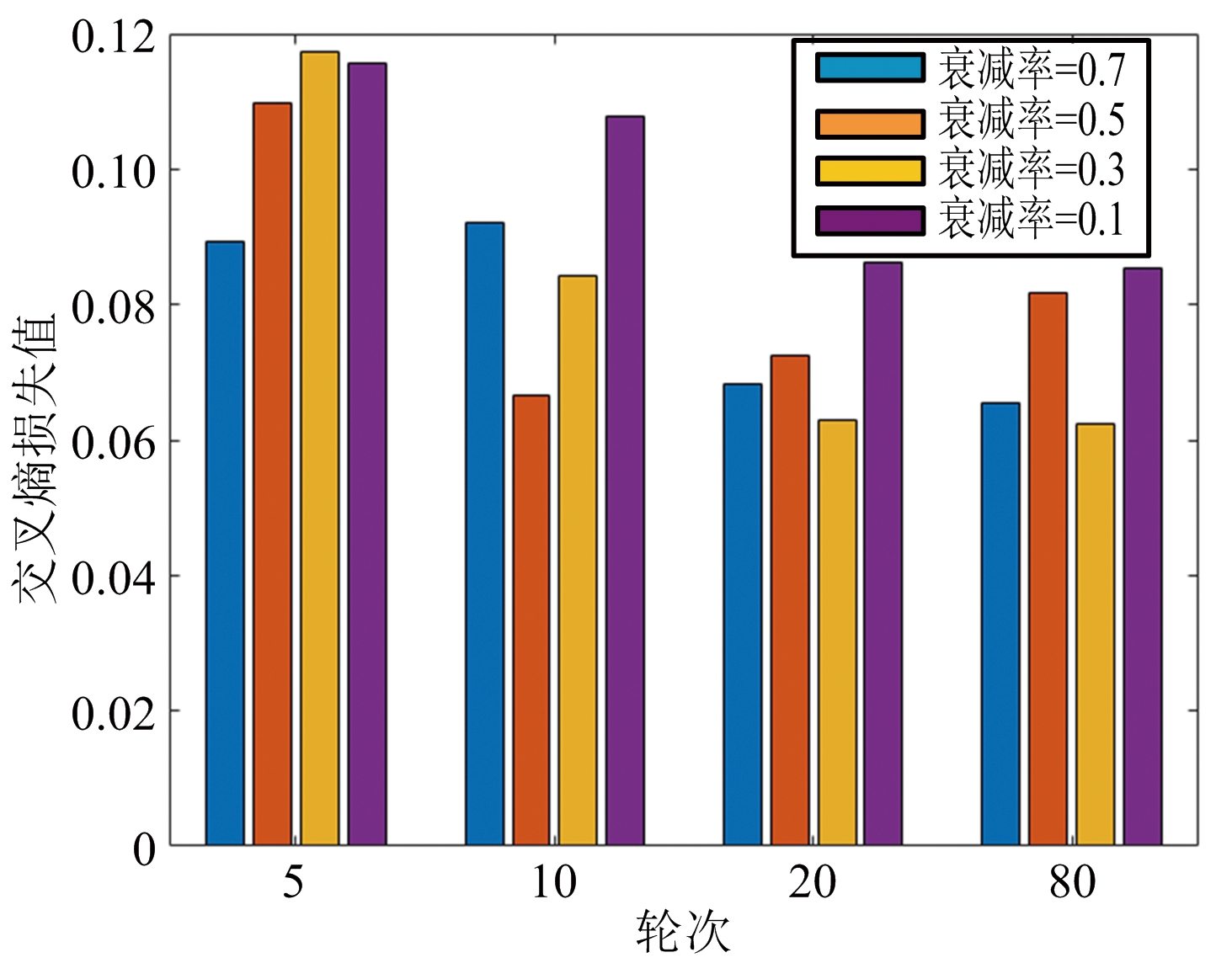

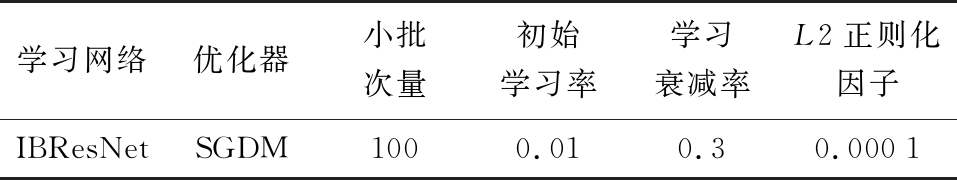

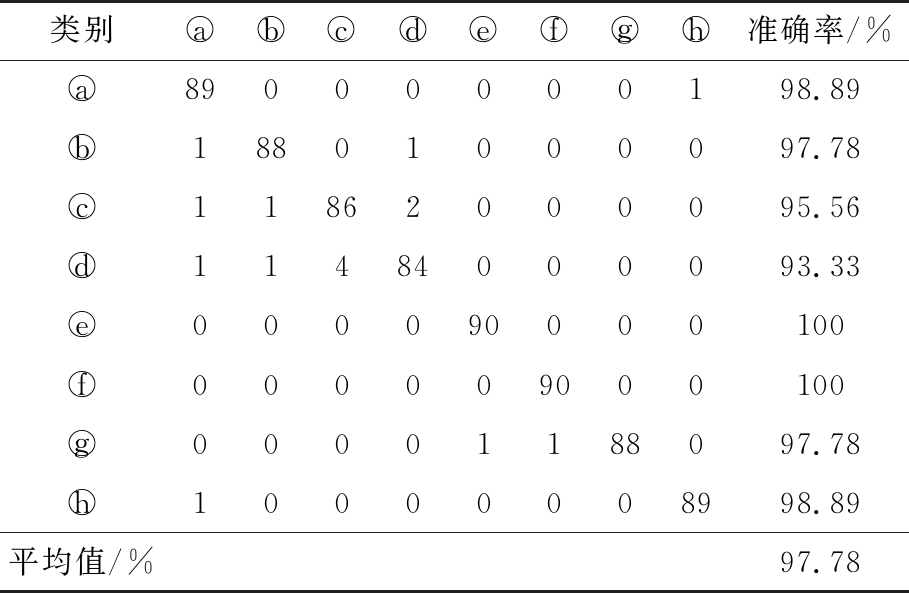

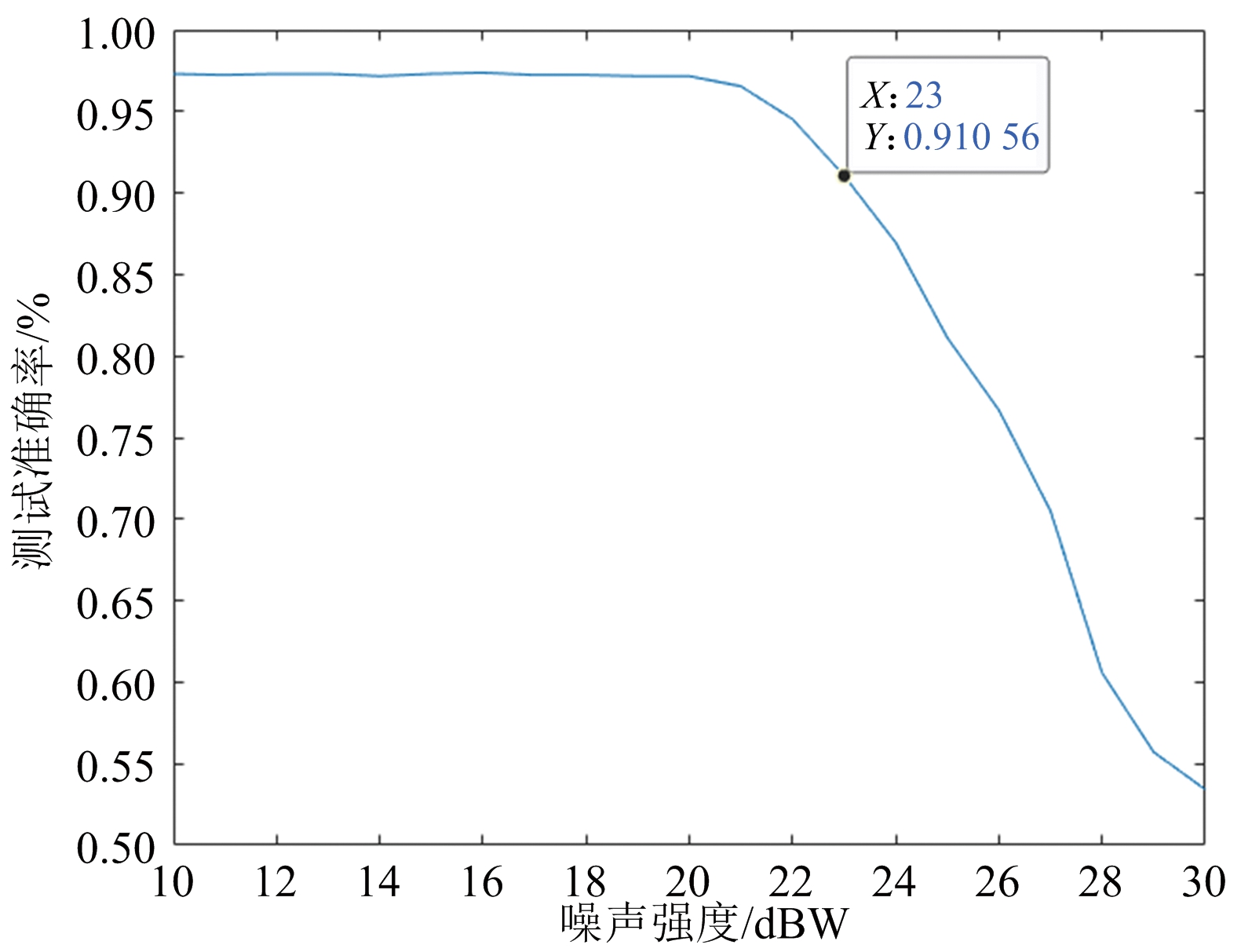

对初始学习率和学习衰减率进行参数寻优。首先将学习衰减率设置为0,然后给出不同的初始学习率,图7显示了训练80个Epoch后不同初始学习率的测试准确率曲线,其中当初始学习率为0.01时准确率较高。图8给出了初始学习率为0.01时,不同学习衰减率的交叉熵损失值的对比结果,其中当学习衰减率为0.3时的损失值收敛情况最好。因此,IBResNet最终采用的训练参数设置如表1所示,最终测试集的混淆矩阵如表2所示,人体姿态的平均准确率可达97.78%,而且周期性强的动作往往识别的精确度更高。进一步通过在测试集上添加高斯白噪声验证网络的泛化能力,该网络在不同噪声强度下的测试准确率如图9所示。噪声强度以1 dBW的间隔遍历10 dBW到30 dBW的范围,当噪声强度增加到23 dBW后,该网络仍有较高的识别率,可达91.05%,而随着噪声强度的增加,准确率快速下降。

图7 不同初始学习率的测试准确率曲线

图8 不同衰减率的交叉熵损失值

表1 IBResNet的训练参数设置

学习网络优化器小批次量初始学习率学习衰减率L2正则化因子IBResNetSGDM1000.010.30.0001

表2 测试集的混淆矩阵

类别○a○b○c○d○e○f○g○h准确率/%○a89000000198.89○b18801000097.78○c11862000095.56○d11484000093.33○e000090000100○f000009000100○g00001188097.78○h10000008998.89平均值/%97.78

图9 不同噪声强度下的测试准确率

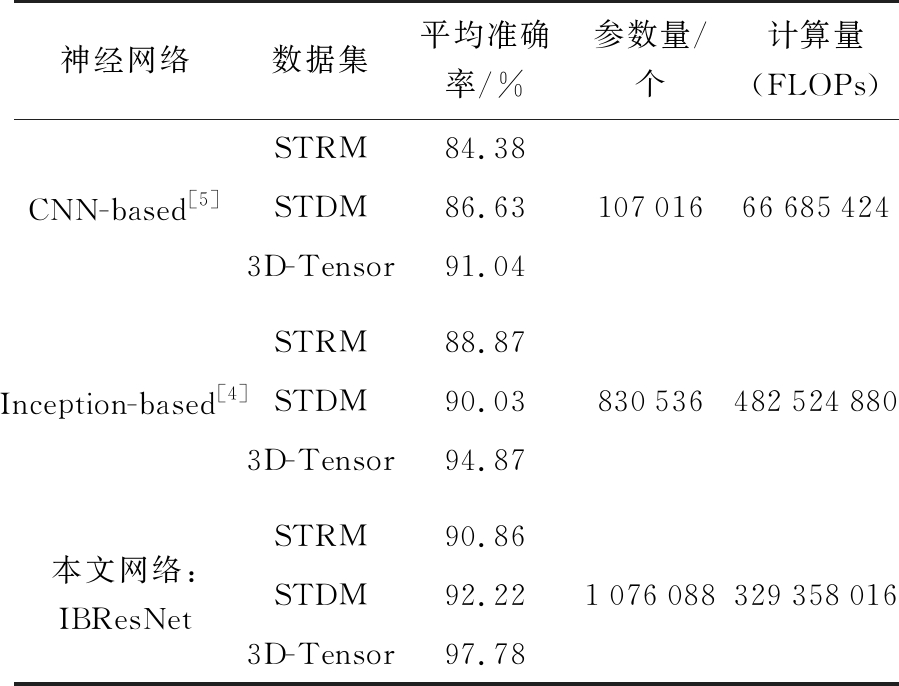

3.4 不同网络之间的性能对比

分别将STRM、STDM和3D-Tensor数据集作为训练数据,通过训练不同的神经网络进行比较。比较的神经网络有文献[5]中的CNN-based和文献[4]中的Inception-based,性能对比结果如表3所示。由表可知,使用3D-Tensor数据集代替单一特征谱图作为网络的输入可以提高人体姿态的识别率,其识别率提高了4%~7%;此外,相对于文献[5]来说,IBResNet结构更加复杂,网络宽度和深度都有所提升,因此参数量和计算量也更大,但是识别的准确率却得到了明显的提高;相对于文献[4]来说,IBResNet的参数量更多,是因为网络中引入了IBRM,适当地扩展了网络的深度,使得网络的搜索空间更大,对数据特征的提取更加深入,而计算效率更高则归功于卷积核尺寸和步长的调整,在保证识别率的前提下,使整个网络训练时间下降了1/4,体现了本文网络的优越性。

表3 性能对比

神经网络数据集平均准确率/%参数量/个计算量(FLOPs)CNN-based[5]STRM84.38STDM86.633D-Tensor91.0410701666685424Inception-based[4]STRM88.87STDM90.033D-Tensor94.87830536482524880本文网络:IBResNetSTRM90.86STDM92.223D-Tensor97.781076088329358016

4 结束语

本文通过对人体姿态的SFCW雷达信号进行距离成像和时频分析,生成人体姿态的STDM和STRM,然后提取出STRM的幅值信息以及STDM的幅值信息和相位信息构成3D-Tensor的数据集,实现多维特征的融合。实验证明多维特征数据在人体姿态识别中准确率更高,相比于特征形式单一的数据,识别率提升了4%~7%;此外,本文基于3D-Tensor的数据集,提出了一种改进型瓶颈残差神经网络的识别方法,实验表明该方法在测试集上的识别率可达97.78%。因为人体在完成一个动作后才能生成相应的谱图,如果在固定时间内动作不完整或存在两种动作时就很难区分出来,因此接下来将研究穿墙雷达中基于图像序列的人体姿态识别方法。

[1] FAIRCHILD D P, NARAYANAN R M. Micro-Doppler Radar Classification of Human Motions Under Various Training Scenarios[J]. Proceedings of SPIE - The International Society for Optical Engineering, 2013, 8734(11):197-200.

[2] AMIN M G, ZHANG Y D, AHMAD F, et al. Radar Signal Processing for Elderly Fall Detection: The Future for in-Home Monitoring[J]. IEEE Signal Processing Magazine, 2016, 33(2):71-80.

[3] SADREAZAMI H, BOLIC H, RAJAN S. CapsFall: Fall Detection Using Ultra-Wideband Radar and Capsule Network[J]. IEEE ACCESS, 2019,7:55336-55343.

[4] SHAO Yuming, DAI Yulong, YUAN Longzhi, et al. Deep Learning Methods for Personnel Recognition Based on Micro-Doppler Features[C]∥ Proceedings of the 9th International Conference on Signal Processing Systems , Auckland New Zealand:Association for Computing Machinery,2017:94-98.

[5] SHAO Yuming , GUO Sai , SUN Lin , et al. Human Motion Classification Based on Range Information with Deep Convolutional Neural Network[C]∥ 2017 4th International Conference on Information Science and Control Engineering,Changsha:IEEE,2017:1519-1523.

[6] 谢晓兰, 陈梓涵.基于时间距离像的人体动作深度学习分类[J].桂林理工大学学报,2019,39(1):197-203.

[7] EROL B, AMIN M G. Radar Data Cube Processing for Human Activity Recognition Using Multi Subspace Learning[J]. IEEE Trans on Aerospace and Electronic Systems,2019,55(6):3617-3628.

[8] 王勇, 吴金君, 田增山,等. 基于FMCW雷达的多维参数手势识别算法[J]. 电子与信息学报,2019,41(4):822-829.

[9] JIA Yong, GUO Yong, YAN Chao, et al. Detection and Localization for Multiple Stationary Human Targets Based on Cross-Correlation of Dual-Station SFCW Radars [J].Remote Sensing,2019,11(12):1428.

[10] QI Fugui, LV Hao, LIANG Fulai, et al. MHHT-Based Method for Analysis of Micro-Doppler Signatures for Human Finer-Grained Activity Using Through-Wall SFCW Radar[J]. Remote Sensing, 2017, 9(3):260.

[11] 张选, 胡晓娟. 基于GoogLeNet和ResNet的深度融合神经网络在脉搏波识别中的应用[J]. 计算机系统应用,2019,28(10):15-26.

[12] 张晓玲, 张天文, 师君, 等. 基于深度分离卷积神经网络的高速高精度SAR舰船检测[J]. 雷达学报,2019,8(6):841-851.