0 引言

随着人工智能的快速发展,深度学习方法在光学图像处理领域受到了越来越多的应用[1],尤其是卷积神经网络(Conventional Neural Network,CNN)[2],在图像分类方面效果十分明显。与传统的人工提取图片特征方式不同,CNN通过共享卷积核进行自适应的图片特征提取,该过程不需要复杂计算和人工干预,解决了特征选取困难的问题[3]。2012年,CNN在ImageNet大赛上夺得了冠军,战胜传统的分类方法而名声大噪。自此CNN再次进入研究者的视野,并且获得了蓬勃发展。各种新的CNN网络如雨后春笋般涌出,网络变得越来越深、越来越宽,在图像识别方面效果也越来越好[4-6]。

CNN不仅大量用于光学图像处理,在合成孔径雷达(Synthetic Aperture Radar, SAR)图像中也能有效地进行目标识别[7-14]。文献[9]中,作者对多个实验结果进行对比分析,结果表明卷积神经网络与其他分类器相比,对目标特征的提取更具鲁棒性,在目标图像发生较小改变时特征能维持稳定,识别效果更好。文献[8]使用较深的卷积神经网络,直接从SAR图像训练集中学习到目标具有判别性的特征,能够高效准确地进行目标检测与识别。

随着CNN网络深度的增加,网络模型的训练显得越来越困难,模型出现难收敛或者不收敛的问题,而且还会出现模型退化的现象,即深度较深的模型效果不如较浅的模型。由此,何凯明等人于2015年提出了残差网络(Residual Network, ResNet)[5]。ResNet的主要贡献在于设计了残差块结构,输入可以跳跃式地跨层前向传播,从而有效地解决了上述模型训练问题。

文献[14]指出,在残差网络的训练过程中,网络梯度变化主要是由残差网络的分支主导的。该文献作者在测试中发现,虽然将正常链接移除掉,仅仅留下分支,网络的表现性也很好,准确率很高,这表明网络分支的贡献很大。在该认识的启发下,本文在残差网络的基础上设计出了多个分支结构的卷积神经网络,并命名为密集连接型残差网络(Densely Connected Residual Network, DCResNet),用于SAR图像中的车辆目标识别。本文基于MSTAR数据集对DCResNet网络进行了多方面的测试,实验结果表明,DCResNet网络在SAR图像车辆目标识别中具有很好的效果。

1 传统残差模块与密集连接型残差模块

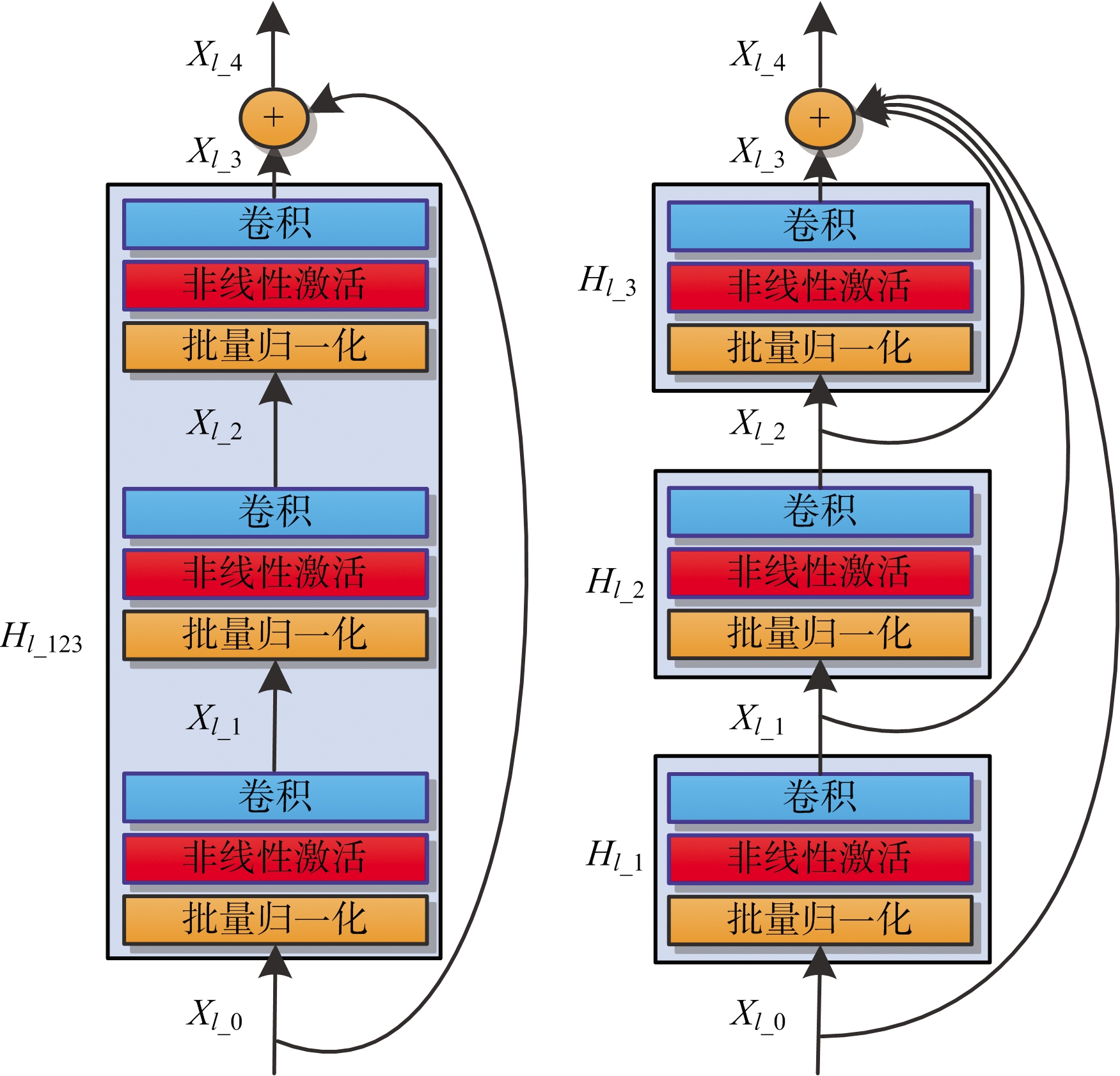

传统ResNet中的残差模块的连接方式如图1(a)所示,输出Xl_4是两部分相加之和,一部分就是该模块的输入Xl_0,另一部分是Xl_0经过多组(图中是3组)非线性运算后的结果Xl_3,所以有

Xl_4=Xl_3+Xl_0=Hl_123(Xl_0)+Xl_0

(1)

式中,Hl_123( · )表示整个残差模块对输入数据的总的运算。值得注意的是,由于最后的相加要求特征图尺寸相同,所以Xl_3与输入Xl_0的尺寸要相同,即具有相同的行数、列数和层数。

由图可知,输入Xl_0要经过3组类似的非线性运算,它们的输出分别是Xl_1、Xl_2和Xl_3。每组运算都包含3个步骤,分别是批量归一化处理(Batch Normalization)、非线性激活函数处理(Relu)和卷积处理(Convolution)。

DCResNet是本论文在传统ResNet的基础上,改进而得到的卷积神经网络模型。DCResNet中的密集连接型残差模块(DC残差模块)是由多个分支组成的结构。理论上,分支的数量不限,可以灵活变动,本文实验中采用2个或3个分支。以3个分支为例,DC残差模块进行3次跳跃性连接,具体操作如图1(b)所示。

(a) 传统残差模块 (b) 密集连接型残差模块

图1 传统残差模块和密集连接型残差模块结构

由图1可知,与传统ResNet一样,输入Xl_0也要经过3组非线性运算。但不同的是,每组非线性运算后得到的特征图都会作为一个因子,用于最后相加而得到模块输出的特征图。为了保证数据流的尺寸不变,每个DC残差模块中的卷积核的尺寸相同,本文中卷积核的尺寸都是选用3×3。

上图DC残差模块中的输入输出关系表示如下:

Xl_1=Hl_1(Xl_0)

(2)

Xl_2=Hl_2(Xl_1)

(3)

Xl_3=Hl_3(Xl_2)

(4)

Xl_4=Xl_3+Xl_2+Xl_1+Xl_0=

Hl_3(Hl_2(Hl_1(Xl_0)))+

Hl_2(Hl_1(Xl_0))+Hl_1(Xl_0)+Xl_0

(5)

式中,Xl_1表示经过第1组非线性运算之后的输出,Hl_1(·)表示第1组非线性运算函数。其他公式以此类推,在此不一一赘述。Xl_4表示整个密集连接型残差模块的输出,是由模块的输入及每组非线性运算的输出一起相加而得到的。

DCResNet的每个残差模块中都有多组非线性运算,每组非线性运算都是在卷积前添加批量归一化和非线性激活函数。批量归一化处理可以防止过拟合并加快收敛,非线性激活函数使网络具有较好的非线性拟合能力,除此之外,模块中使用的跳跃性连接使网络具有良好的易训练性。本网络在继承了ResNet优点——抑制了梯度消失和梯度爆炸的问题以外,还增加了特征的传播和利用率。

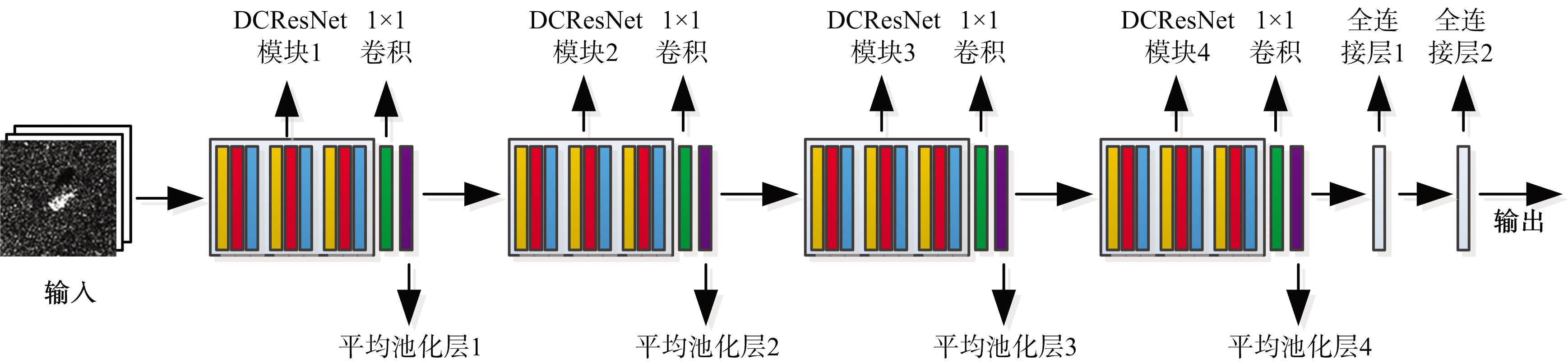

2 密集连接型残差网络结构

一个完整的DCResNet网络主要由输入、多个DC残差模块与下采样的组合、两个全连接层和输出组成,如图2所示。输入(Input)就是需要处理的图像数据。图中共有4个DC残差模块,出于简化图示的目的,本文略去了模块中的连接线,只是使用3组黄红蓝矩形框来表示,颜色与图1是一致的。每个DC残差模块后搭配一组下采样,包括绿色矩形框表示的1×1卷积层、紫色矩形框表示的平均池化层。最后是两个灰色矩形框,分别表示全连接层1和全连接层2,而全连接层2也就是输出层,该层给出目标的具体类别信息,即输出(Output)。

图2 DCResNet-3_18网络结构

在ResNet的下采样操作中,在旁支中加入卷积来调整残差模块的输出通道数量。本文在DCResNet中,在平均池化层前用1×1卷积层来改变残差模块的输出通道数量。为了抑制SAR图像中的噪声对目标识别所产生的不利影响,在DCResNet中采用平均池化的方式进行下采样,改变数据的长与宽两个维度。

为了将DCResNet的网络结构信息直观表现,本文作了一个简单的DCResNet网络命名规则。以图2中的网络为例,本文命名为DCResNet-3_18,其中的3表示每个DC残差模块含有3个卷积层;18则表示整个网络结构中总共有18个卷积层:有4个DC残差模块,一共就有12个卷积层,再加上4个1×1卷积层和2个全连接层,其中全连接层本质也是卷积层。

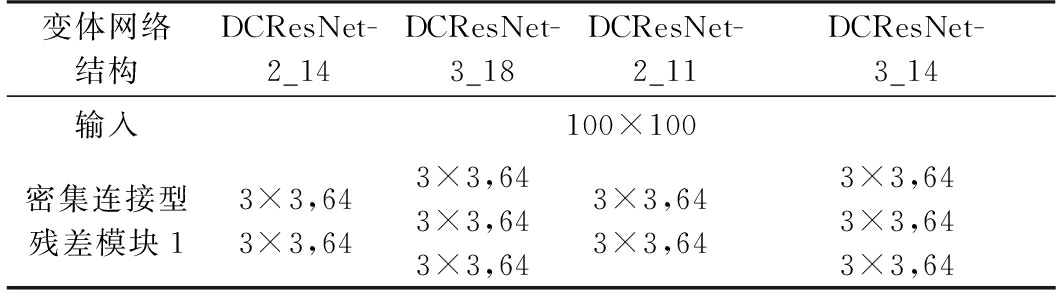

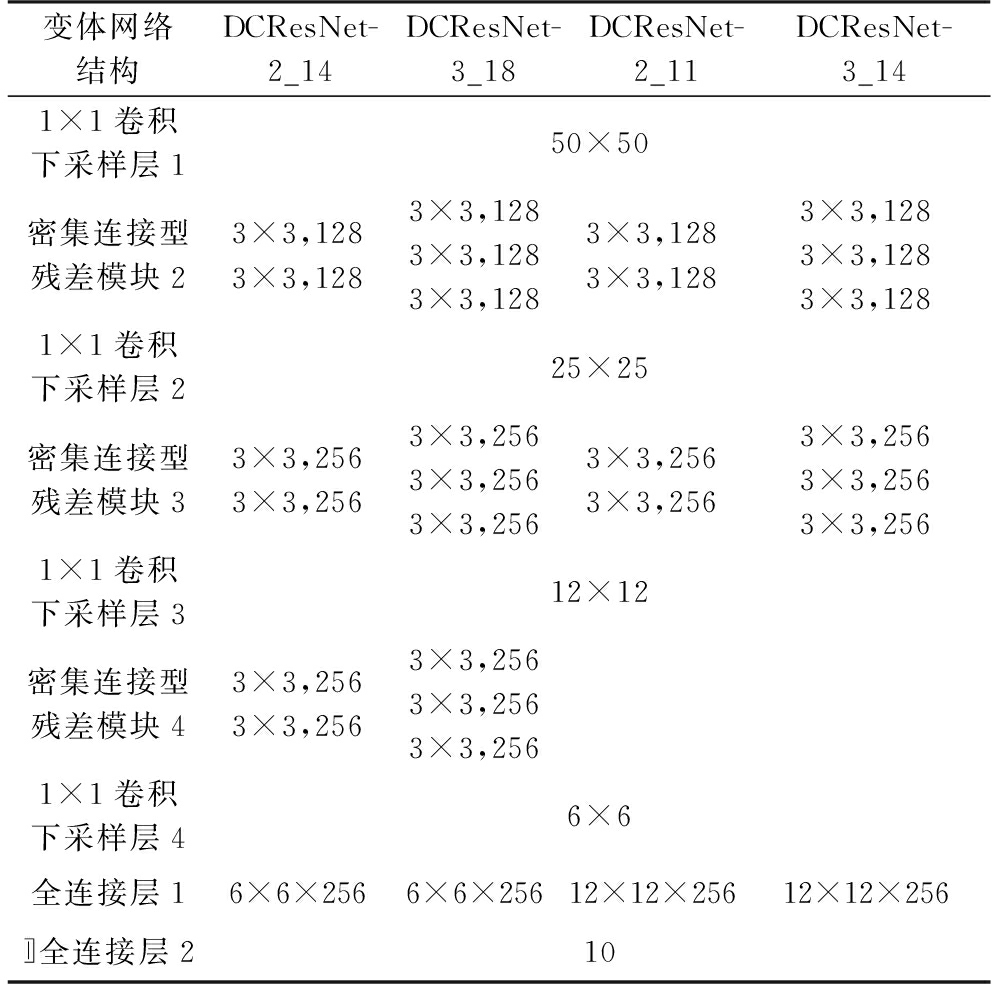

本文共实验了4个DCResNet的变体网络,表1展示了各个变体网络的具体细节信息。最后的全连接层2的尺寸是10,指的是本文实验中一共有10类目标。

表1 DCResNet系列变体网络结构信息

变体网络结构DCResNet-2_14DCResNet-3_18DCResNet-2_11DCResNet-3_14输入100×100密集连接型残差模块13×3,643×3,643×3,643×3,643×3,643×3,643×3,643×3,643×3,643×3,64

续表

变体网络结构DCResNet-2_14DCResNet-3_18DCResNet-2_11DCResNet-3_141×1卷积下采样层150×50密集连接型残差模块23×3,1283×3,1283×3,1283×3,1283×3,1283×3,1283×3,1283×3,1283×3,1283×3,1281×1卷积下采样层225×25密集连接型残差模块33×3,2563×3,2563×3,2563×3,2563×3,2563×3,2563×3,2563×3,2563×3,2563×3,2561×1卷积下采样层312×12密集连接型残差模块43×3,2563×3,2563×3,2563×3,2563×3,2561×1卷积下采样层46×6全连接层16×6×2566×6×25612×12×25612×12×256〛全连接层210

3 实验数据集

本文所有实验数据均来源于美国DARPA公布的MSTAR(The Moving and Stationary Target Recognition)数据集。该数据集中包含大量车辆目标的SAR图像切片,共有包括自行榴弹炮、装甲侦察车、装甲运输车、推土机、坦克、货运卡车、自行高炮、坦克等在内的10种型号,分别是BMP2、BTR70、T72、BTR60、2S1、BRDM2、D7、T62、ZIL131、ZSU234,此处给出其中的个别SAR图像样本如图3所示。

图3 10种车辆目标SAR图像样本

其中每一类车辆目标均只有15°和17°两种不同俯仰角下所测得的数据,但两个俯仰角下的数据在方位角上均覆盖0°~360°。俯仰角17°的数据共有2 747个,本文作为训练数据集,俯仰角15°的数据共有2 425个,本文作为测试集。为了更加有利于实验,本文将所有SAR图像切片从中心点向外延伸,裁剪出100×100大小的图片。除此之外,不对数据集作任何处理,用于验证不同卷积神经网络的目标识别性能。

4 算法代码编写与实验结果分析

本文的目标识别代码基于Python语言和TensorFlow框架编写。计算机的操作系统是64位Windows10,处理器是Intel(R)Core(TM)i7-8700 CPU @3.20 GHz,内存容量为16 GB,显卡是NVIDA GeForce RTX2070(8 GB)。实验参数设置如下:epoch总数为80,起始学习率为0.01,当训练epoch到达40的时候学习率降低为0.001,当训练epoch到达70的时候学习率降低为0.000 1;批量大小batch_size统一为20;权重衰减weight_decay为1×10-4;神经元随机失活率为0.2。本次实验使用adam优化器,epsilon设为 1×10-8,momentum设为0.9。

4.1 不同DCResNet变体之间的性能比较

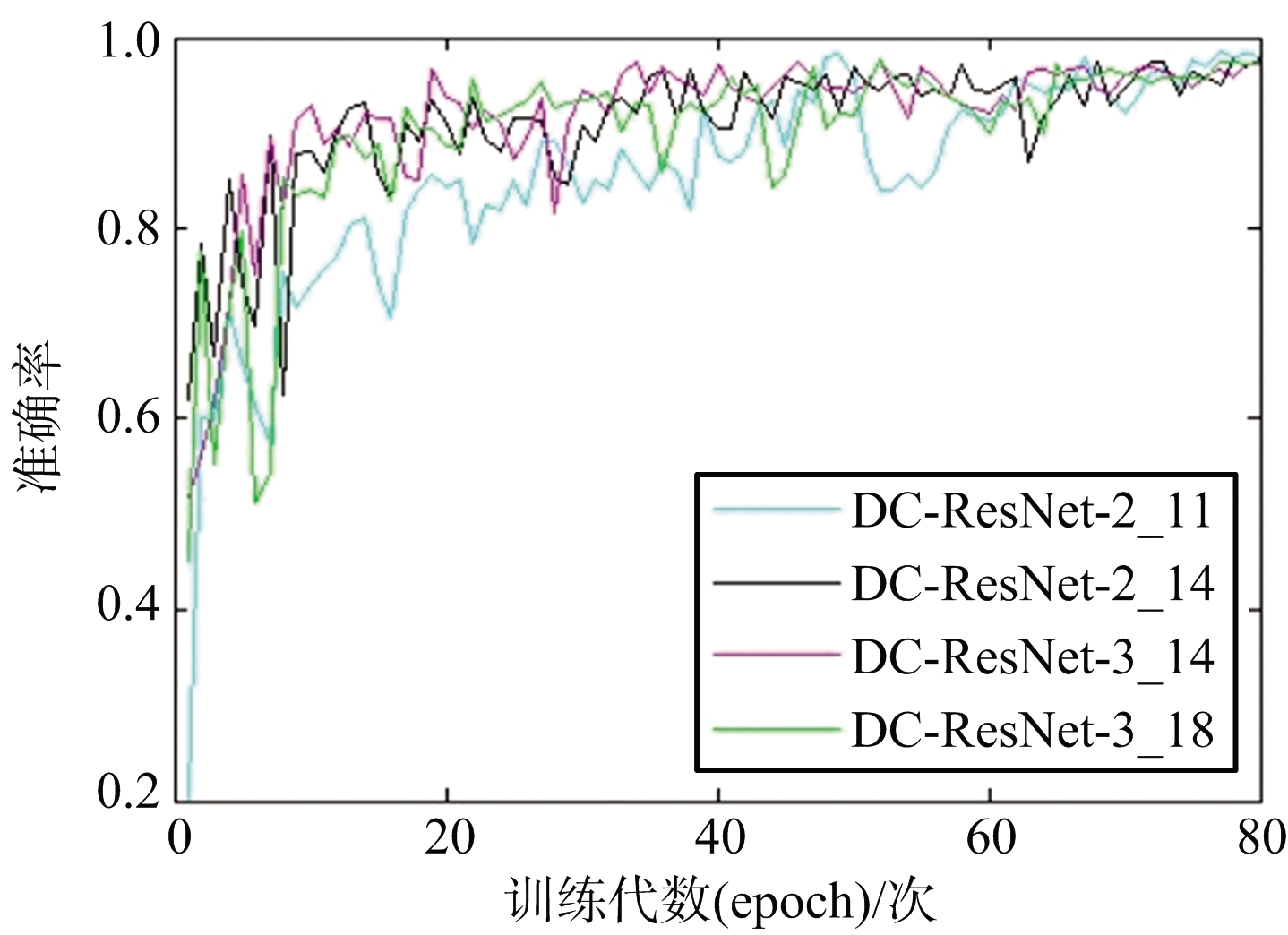

本文比较了4种DCResNet变体网络在训练过程中前80个epoch(训练代数)的测试集准确率变化,如图4所示。由图可见,4种网络在训练过程初期,准确率的波动比较大,这是由于训练初期学习率设置较大的原因,随着网络训练的进行这种现象逐渐得到改善。

图4 DCResNet系列变体准确率变化对比

其中DCResNet-2_11在前中期表现最差,其原因是网络的总体非线性层数相比其他3种变体网络而言较少。4种网络中,较早进入稳定状态的是DCResNet-2_14以及DCResNet-3_18,这两种网络都是使用了4个DC残差模块,由此可以推测,更多的残差模块对网络的准确性和收敛速度有利。但是最终,4种DCResNet变体网络在MSTAR数据集上的准确率都达到了97%~98%之间。

4.2 不同CNN之间的性能比较

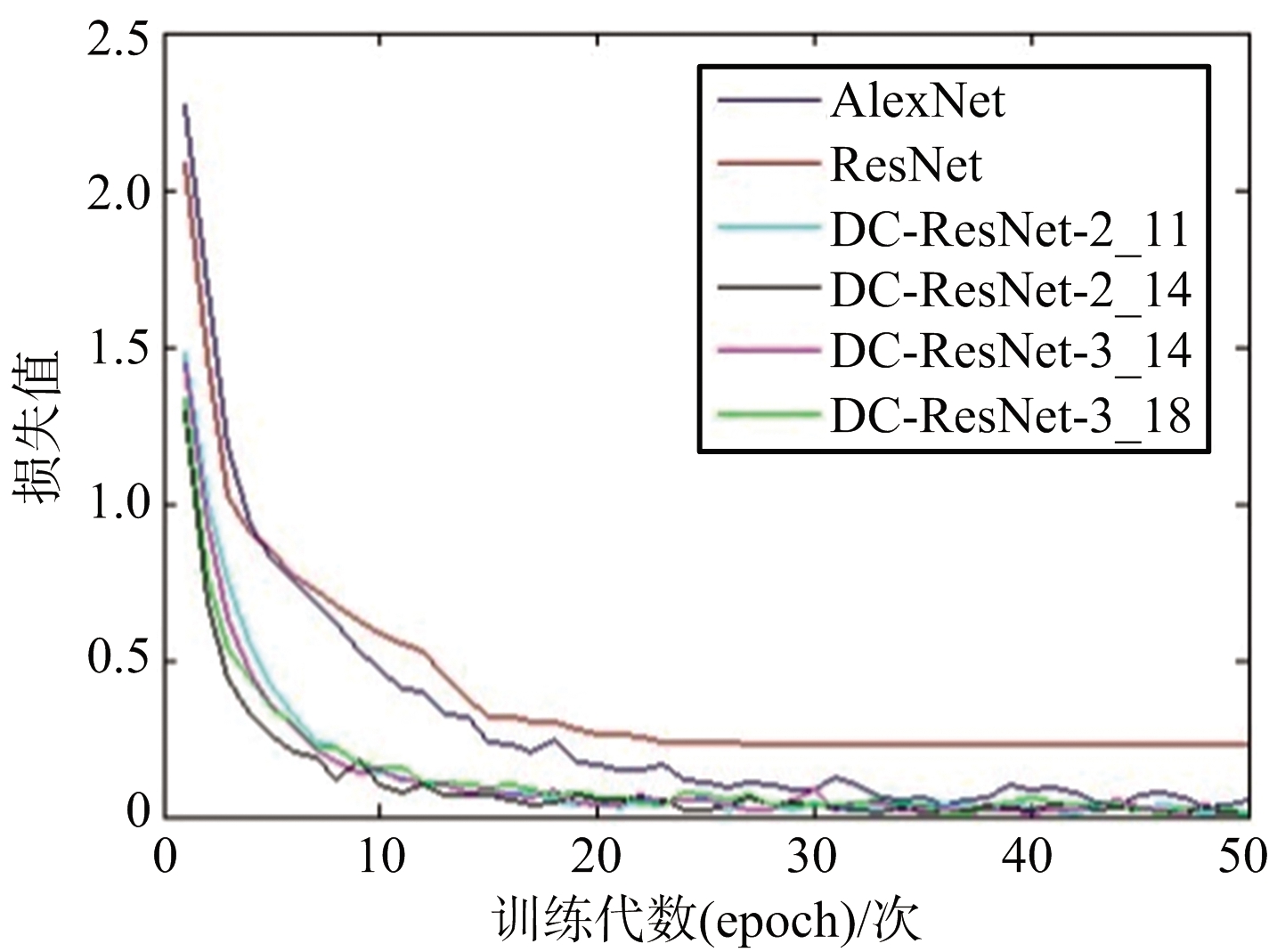

首先,本文对比了AlexNet、ResNet和DCResNet 3种CNN网络的收敛效果和学习能力,其中DCResNet一共给出4个变体网络,实验结果如图5所示。图片展示了前50个epoch中各种网络的损失值变化趋势,每一个epoch表示一个完整训练数据集训练完成。由图可见,4种变体网络的变化趋势大致相似,AlexNet网络的起始损失值最大,但是趋于稳定状态时ResNet-18的损失值却是最大的,DCResNet的4种变体网络起始损失值以及稳定状态损失值相比而言都较低。

图5 多种CNN网络损失值变化对比

由此可知DCResNet在训练时收敛更快,且较低的损失值反映了DCResNet对训练数据良好的学习能力,且网络在训练数据样本较少的时候,不容易表现出过拟合。虽然DCResNet是在ResNet基础上改进而得,但它可以以更少的卷积层数,获得更好的收敛效果和学习能力,这种性能提升源于残差模块内部的多次跳跃性连接和批量归一化处理。

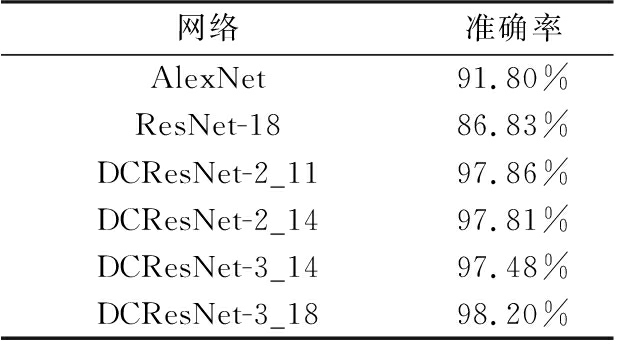

然后,本文进行了DCResNet与AlexNet、ResNet-18之间的准确率比较,如表2所示。这6种网络在准确率方面ResNet-18表现最差,准确率是86.83%。DCResNet-3_18表现最好,准确率是98.20%,其他DCResNet变体的表现也远远领先于AlexNet和ResNet-18。同样由18个卷积层组成,DCResNet-3_18准确率比ResNet-18高近12%。

表2 AlexNet、ResNet-18和DCResNet系列变体准确率对比

网络准确率AlexNet91.80%ResNet-1886.83%DCResNet-2_1197.86%DCResNet-2_1497.81%DCResNet-3_1497.48%DCResNet-3_1898.20%

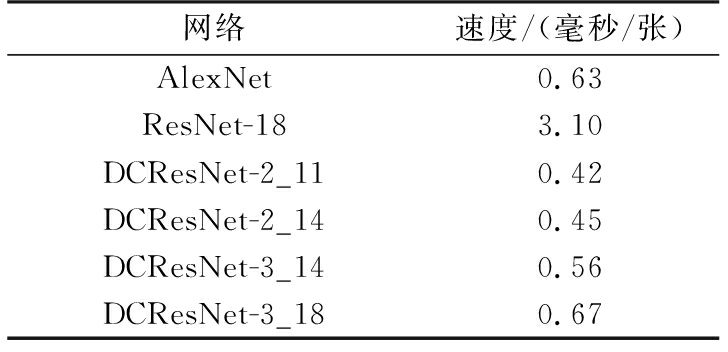

最后,本文对AlexNet、ResNet-18和DCResNet系列网络的推理速度进行了测试和比较,结果如表3所示。其中推理速度最快的是DCResNet-2_11,推理速度最慢的是ResNet-18。DCResNet-3_18与ResNet-18拥有相同的卷积层数,其推理速度却远远快于ResNet-18。

表3 AlexNet、ResNet-18和DCResNet系列变体推理速度对比

网络速度/(毫秒/张)AlexNet0.63ResNet-183.10DCResNet-2_110.42DCResNet-2_140.45DCResNet-3_140.56DCResNet-3_180.67

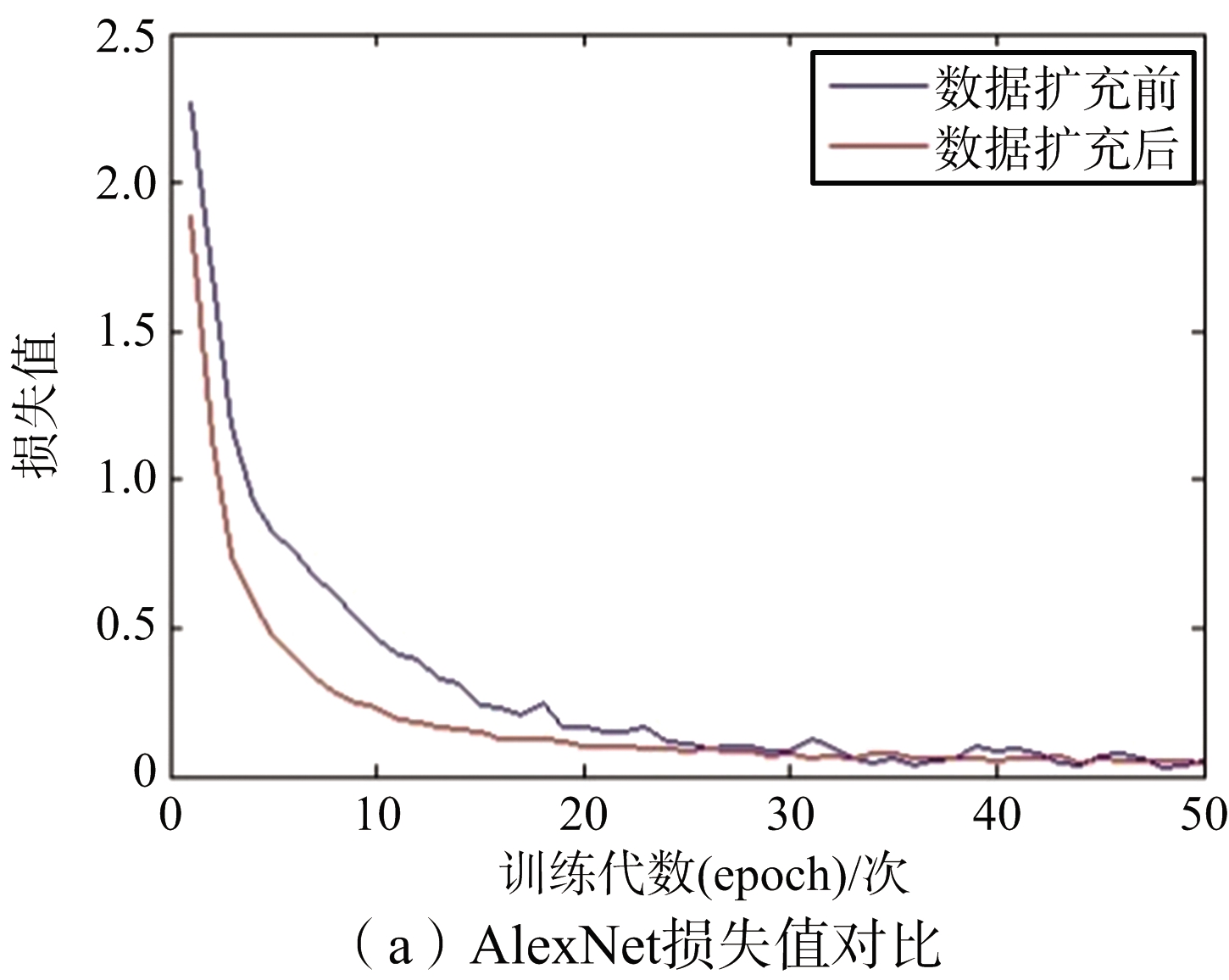

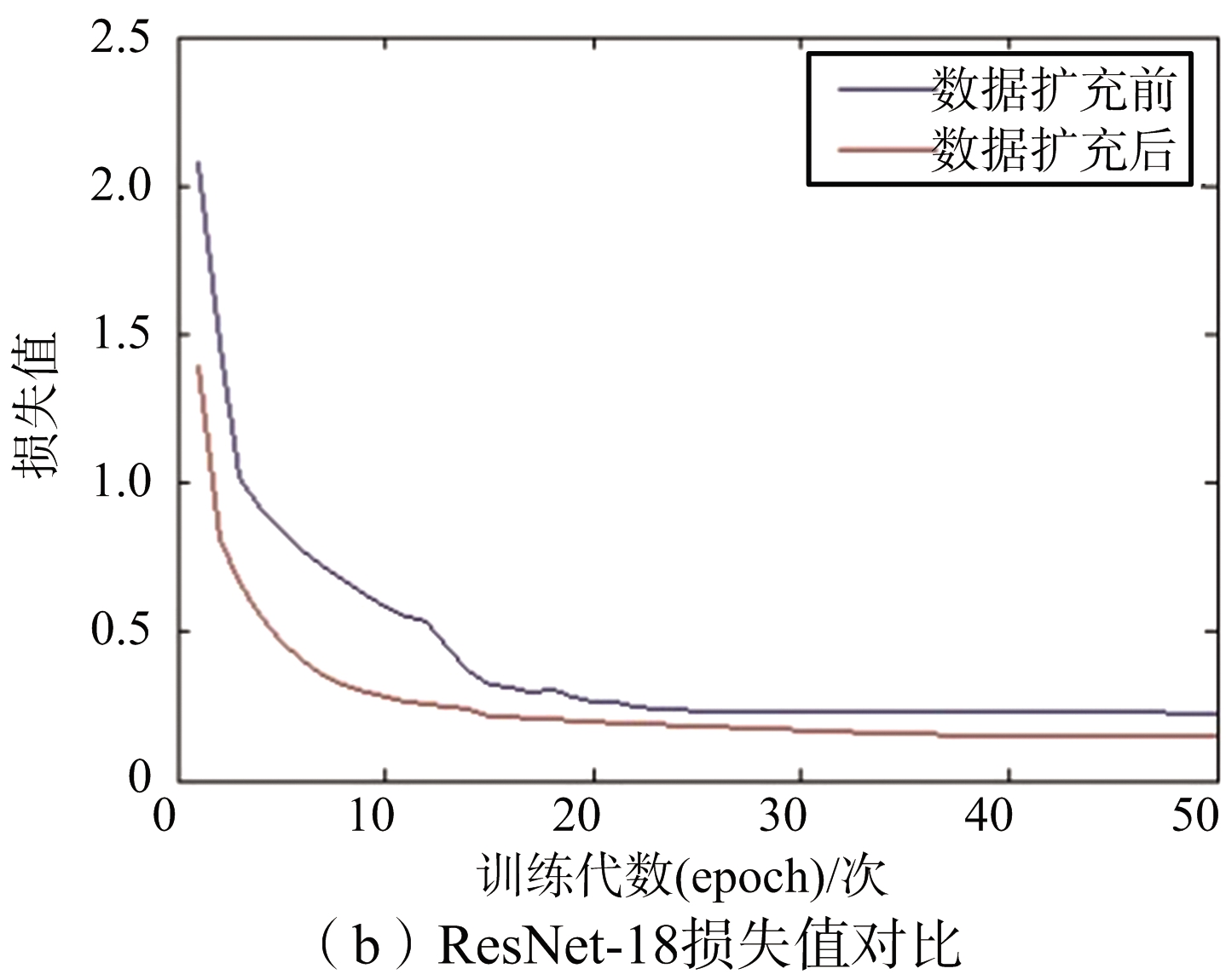

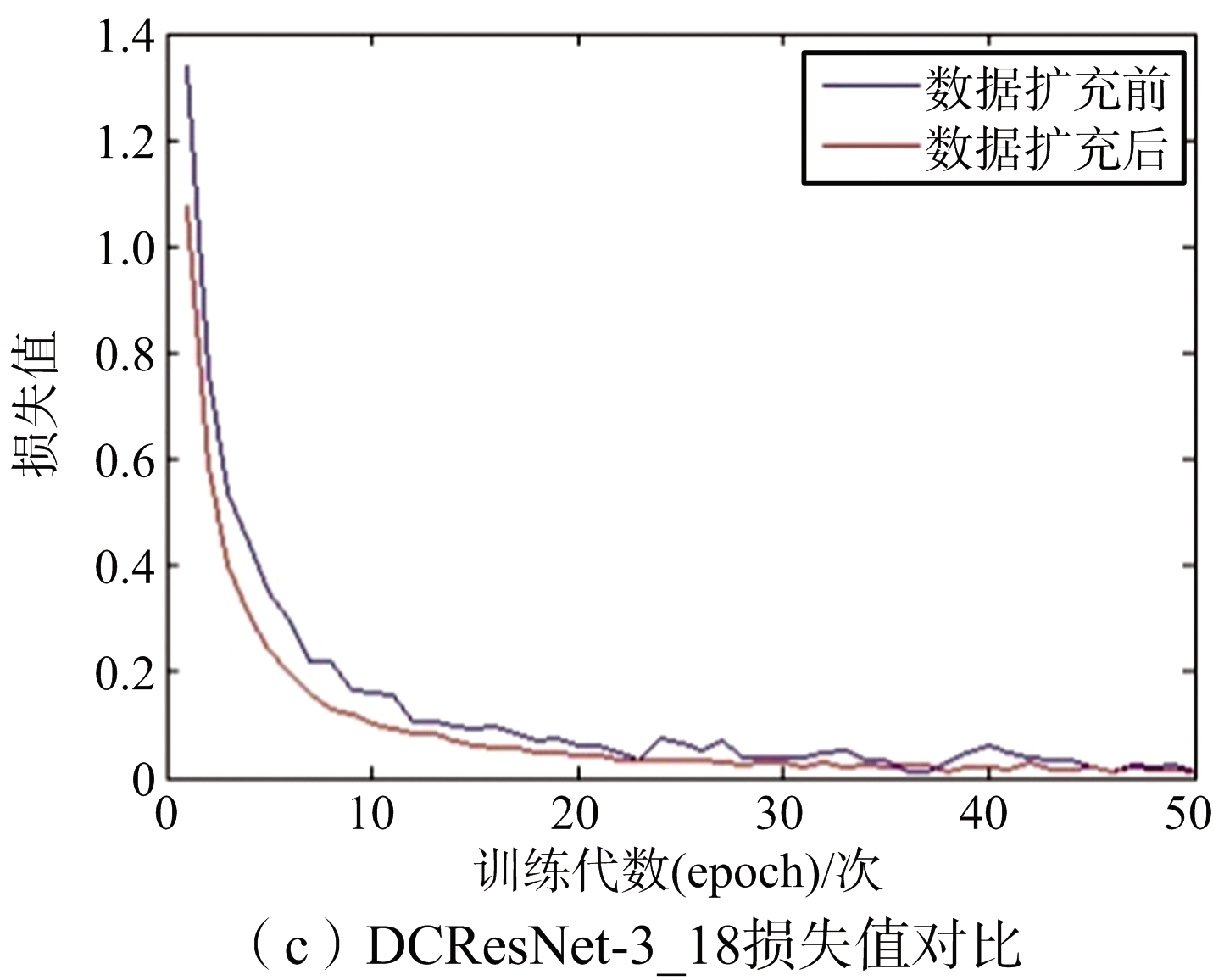

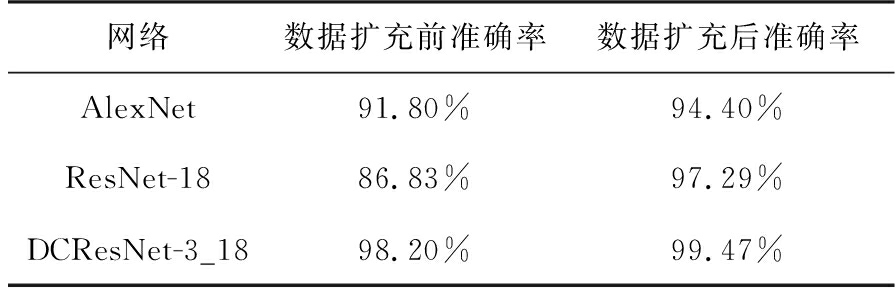

4.3 数据扩充对CNN性能的影响

上文在没有数据扩充的情况下讨论了各种网络模型的性能。在实际工程中,数据扩充是尤为重要的,对于MSTAR这样样本数较少的数据集来说,数据扩充是必不可少的操作。本文研究了数据扩充对网络性能的影响,在实验中,本文通过翻转、平移、多角度旋转等操作,将训练数据集扩充到了原来的6倍。数据集扩充前后,不同CNN网络在训练过程中的损失值变化曲线对比如图6所示。

图6 AlexNet、ResNet-18和DCResNet-3_18在扩充数据集前后的损失值对比

由图6可见,3种网络在数据扩充后的损失值绝大部分时间都低于数据扩充前的损失值,收敛得也更快。损失值表示预测结果与实际结果之间的差距,理论上越低越好,由此可见数据扩充有利于提高CNN网络的性能。数据扩充的效果在ResNet-18网络上表现得最为明显,DCResNet-3_18网络受到的影响较小,这也可以说明本文提出的模型对于小样本学习有很好的表现。

表4给出了训练数据集扩充前后,3种网络的准确率变化。由表4可见,数据集扩充使CNN网络的识别准确率均有不同幅度的提升。其中准确率提升幅度最大的是ResNet-18,超过10%。DCResNet-3_18的准确率也上升1.2%,使得扩充训练集后,识别准确率达到99.47%。

表4 AlexNet、ResNet-18和DCResNet-3_18扩充数据集前后的准确率对比

网络数据扩充前准确率数据扩充后准确率AlexNet91.80%94.40%ResNet-1886.83%97.29%DCResNet-3_1898.20%99.47%

5 结束语

本文在ResNet的基础上,设计出了DCResNet,加密了残差模块中的跳跃性连接,使得每个残差模块里经过不同次数非线性运算的特征都被叠加到残差模块的输出里,从而提高了特征的传播率和利用率,增强了网络的学习能力。实验结果表明,DCResNet与ResNet-18和AlexNet相比,具有更快的推理速度和收敛速度,更高的识别准确率。训练数据集扩充能改善CNN的训练损失值和识别准确率。在采用扩充后数据集进行训练后,DCResNet-3_18的测试集准确率达到了99.47%。

[1] 郑远攀, 李广阳, 李晔. 深度学习在图像识别中的应用研究综述[J]. 计算机工程与应用,2019,55(12):20-36.

[2] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet Classification with Deep Convolutional Neural Networks[C]∥Proceedings of Advances in Neural Information Processing Systems, Lake Tahoe, Nevada, US: NIPS,2012:1097-1105.

[3] BIAN W, TAO D. Asymptotic Generalization Bound of Fisher’s Linear Discriminant Analysis [J]. IEEE Trans on Pattern Analysis & Machine Intelligence,2014,36(12):2325-2337.

[4] SIMONYAN K, ZISSERMAN A. Very Deep Convolutional Networks for Large-Scale Image Recognition [C]∥ICLR 2015, San Diego, CA: ICLR,2015:1-14.

[5] HE K M, ZHANG X Y, REN S Q, et al. Deep Residual Learning for Image Recognition [C]∥IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas, NV, USA:IEEE,2016:770-778.

[6] SZEGEDY C, LIU W, JIA Y Q, et al. Going Deeper with Convolutions [C]∥IEEE Conference on Computer Vision and Pattern Recognition, Boston, MA, USA: IEEE,2015:1-9.

[7] 邹浩, 林赟, 洪文. 采用深度学习的多方位角SAR图像目标识别研究[J]. 信号处理,2018,34(5):513-522.

[8] 张笑. 基于深度学习的SAR图像目标识别算法研究[D]. 南京:南京航空航天大学,2018.

[9] MALMGREN-HANSEN D, ENGHOLM R, PEDERSEN M O. Training Convolutional Neural Networks for Translational Invariance on SAR ATR[C]∥Proceedings of EUSAR 2016: 11th European Conference on Synthetic Aperture Radar, Hamburg, Germany: VDE,2016:1-4.

[10] SHANG R H, WANG J M, JIAO L C, et al. SAR Targets Classification Based on Deep Memory Convolution Neural Networks and Transfer Parameters[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing,2018,11(8):2834-2846.

[11] 薛媛. 基于深度神经网络的SAR自动目标识别方法研究[D]. 成都:电子科技大学,2019.

[12] 贺丰收, 何友, 刘准钆,等. 卷积神经网络在雷达自动目标识别中的研究进展[J]. 电子与信息学报, 2020,42(1):119-131.

[13] HUANG Z L, PAN Z X, LEI B. What, Where and How to Transfer in SAR Target Recognition Based on Deep CNNs[J]. IEEE Trans on Geoscience and Remote Sensing,2020,58(4):2324-2336.

[14] VEIT A, WILBER M, BELONGIE S. Residual Networks Behave Like Ensembles of Relatively Shallow Networks[C]∥Proceedings of the 30th International Conference on Neural Information Processing Systems, Barcelona SPAIN:NIPS,2016:550-558.