0 引 言

时至今日,伴随着数字射频存储器(Digital Radio Frequency Memory, DRFM)技术[1]的逐渐成熟与普及,干扰机能够高速生成样式多态、控制灵活的灵巧干扰[2-4],进一步提升了电子干扰能力。随着信息化技术的发展,基于雷达的科学研究迅速推动了现代作战方式的改变,在作战空间中的复杂电磁环境下,电子对抗成为了现代战争的重要组成部分,雷达系统亟需提高抗干扰能力[5]。快速、有效的环境感知情况可以为雷达后续的干扰抑制提供强有力的保障,干扰识别作为抗干扰的第一步,是雷达抗干扰系统的基础与关键。

近年来,随着深度神经网络在图像分类[6]、目标检测[7]等多个领域取得显著的成果,基于深度学习的干扰识别[8-15]逐渐成为研究的热门方向。文献[8]针对干扰的CWD 时频图像,利用AlexNet 对自动提取的特征进行识别,对5种有源干扰的识别准确率较高。文献[9]设计了一种融合了一维和二维特征的卷积神经网络(Convolutional Neural Networks, CNN),在训练样本有限的情况下,实现了脉冲压缩雷达干扰信号的准确分类,具有较强的干扰信号特征提取能力。文献[10]通过CNN 联合多域提取时域图像和频域序列的特征进行干扰识别,在低干噪比下也能准确分类。文献[11]通过对目标在距离多普勒和角度多普勒平面构建联合特征,建立了一种改进的残差卷积神经网络进行干扰识别。文献[12]设计了一种级联CNN 结构,针对单周期与多周期干扰的伪Wigner-Ville 分布时频二维图像实现干扰识别。文献[13]针对FPGA平台,将干扰信号的距离-多普勒分布作为输入,提出了一种微动态CNN,能够在预测阶段调整网络结构,降低计算复杂度,便于工程应用。文献[14]提出了一种自注意力网络,利用信号时频频谱中的全局信息和真实干扰信号相联合,学习干扰信号频谱中任意两点的相关性,提高识别精度,并且利用知识蒸馏减少推理时间。文献[15]提出了一种基于集成学习和迁移学习的干扰识别网络,数据集是通过提取干扰短时傅里叶变换时频图的实部、虚部、模值和相位进行组合构造,在小样本下有效提升了识别准确率。

以上已有的基于深度学习的干扰识别方法普遍存在着以下问题:在复杂电磁环境中,噪声较强的条件下,干扰识别准确率不高;网络训练完成后干扰特征难以积累,新的干扰对抗情景中,模型需要每次重新训练,总训练时间过长,模型开销较大,不利于工程实现。

为了解决上述问题,针对干扰机产生的新式灵巧干扰,本文设计了一种基于动态权重的知识积累(Dynamic Weighted Knowledge Accumulation method based on Convolutional Neural Network, DWKA-CNN)干扰识别方法。该方法将干扰信号的平滑伪Wigner-Ville 分布(Smooth Pseudo Wigner-Ville Distribution,SPWVD)图像作为卷积神经网络的输入,设计了动态权重最近邻分层屏蔽网络权重的算法,在不停变化的干扰对抗环境中,避免了网络每次重新训练,减少了模型开销,实现了在单一网络中学习多项干扰识别任务,完成了知识在网络中的积累,并且提升了低干噪比下网络的干扰识别准确率。

1 方法介绍

1.1 干扰信号模型及数据生成

本文算法主要针对雷达灵巧干扰进行识别分类。基于数字射频存储器(Digital Radio Frequency Memory,DRFM)生成的灵巧干扰根据干扰特点可以分为间歇采样转发干扰(Interrupted Sampling Repeater Jamming,ISRJ)和灵巧噪声干扰(Smart Noise Jamming,SNJ)[4]。本文算法主要以LFM 雷达信号为基础进行干扰分析研究。假设雷达发射的线性调频信号s(t)表示为

式中,A 为信号幅度,T 为脉冲宽度,f0 为信号载波频率,K为调频斜率。

干扰机进行雷达信号采样的矩形脉冲串p(t)表示为

式中,τ 为采样信号脉冲宽度,Ts 为采样信号脉冲重复周期,即fs=1/Ts。

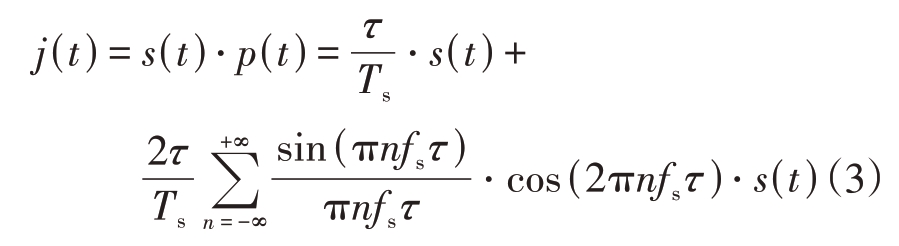

干扰机产生的间歇采样转发干扰信号j(t)为

根据采样和转发策略的不同,ISRJ 可以分为间歇采样直接转发干扰(Interrupted Sampling and Direct Repeater Jamming,ISDRJ)、间歇采样重复转发干扰(Interrupted Sampling and Periodic Repeater Jamming,ISPRJ)、间歇采样循环转发干扰(Interrupted Sampling and Cyclic Repeater Jamming,ISCRJ)。

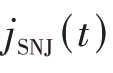

卷积调制的全脉冲转发处理的SNJ 型灵巧干扰信号 为

为

式中,n0(t)为高斯白噪声,hBP(t)为带通滤波器,hHlibert(t)为希尔伯特滤波器。乘积调制的全脉冲SNJ型灵巧干扰信号j'SNJ(t)为

而切片SNJ 干扰是基于ISRJ 原理,在干扰生成阶段加入噪声调制,从而形成了卷积调制灵巧噪声干扰(Smart Noise Jamming with ConvolutionModulation,CM_SNJ)和乘积调制灵巧噪声干扰(Smart Noise Jamming with Multiplication Modulation,MM_SNJ),其具体干扰生成模型表达式为

由于本文主要使用卷积神经网络对干扰进行识别检测,而对于CNN 而言,二维图像才是最适合进行处理的数据类型。基于脉冲级特征的参数向量约束条件多,特征明确,会给CNN 带来过拟合与非完备的影响。本文算法采用时频分析方法中的Wigner-Ville分布(Wigner-Ville Distribution,WVD)[16]对干扰信号进行分析。WVD 是信号的双线性函数,而干扰、噪声和雷达目标回波在时域上往往会产生交叠,从而导致产生的时频二维图像存在交叉的相干项,这些相干项会与信号产生重叠,并且无论距离如何衰减均会对结果造成影响,使得很难对时频二维图像作出直观的解释。

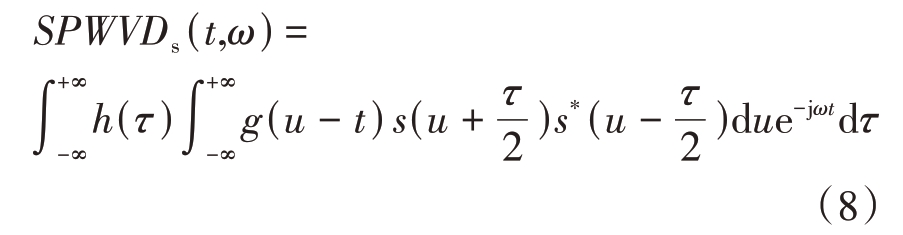

为了减少交叉项干扰,通过对t 和τ 分别加窗函数,独立控制两个窗函数的长度,采用SPWVD[17]对信号s(t)进行分析可以得到以下分布:

式中h(τ)和g(t)均为窗函数,本文中采用Kaiser窗。这种对信号的独立平滑处理可以有效抑制WVD 中出现的交叉项干扰,并且能够同时在时域和频域上获得较高的分辨率。

1.2 基于动态权重的知识积累干扰识别方法

本文算法目标是在不停变化的干扰对抗环境下,用一个单一网络完成多次干扰信号的识别,在保持较高干扰识别准确率的同时缩短整体的训练时间,提升模型的抗噪声能力。

当新任务t 加入网络中训练时,训练集为Dt,此时网络模型的l层的输出维度为ml,该层的输出向量 可以表示为

可以表示为

式中:f(·)为非线性激活函数,本文算法在基础模型架构中采用ReLU 函数;![]()

![]() 为网络学习任务t 时的权重矩阵,且

为网络学习任务t 时的权重矩阵,且![]() ,其中未固定的所有权重设为

,其中未固定的所有权重设为 ,未固定权重数量为

,未固定权重数量为 ;b(l)为该层的偏置。

;b(l)为该层的偏置。

CNN 是由多层线性投影和非线性的激活函数组成的。网络通过调节神经元的权重进行训练,权重的值代表从特定任务中学习到的知识。最近几年,大量的神经网络模型压缩方向的研究[18-20]证明,神经网络中的知识存在冗余,算法通过在对应的卷积层和线性层删除权重和修剪冗余连接,可以有效地降低网络模型中的冗余。网络经过修剪后,释放出的权重参数可以被用来学习新的知识,从而在网络中进行知识的积累。因此,本文中网络在完成一次干扰识别任务后,结合均值最近邻策略,根据动态变化的权重决定剪枝的百分比,使用逐层修剪权重的方式,将当前任务t 的必要知识保留在模型中,实现在单一网络中多次识别干扰。

在完成一次干扰识别任务后,若l 层对应的为全连接层(Fully Connected layer, FC)或卷积层(Convolutional layer, Conv)时,其中所有未固定权重经过贝塞尔校正后的均值 为

为

那么需要固定在网络中的权重数量为N(l)t*,则当前模型层级保留权重的百分比g(l)t 为

在实验中发现,采用均值最近邻策略保留权重,能够更好地在网络中保存已学习的知识,干扰识别准确率也更高。假设网络学习当前任务t 时,需要保持不变的权重集合为 ,算法遵循均值最近邻原则保留权重:

,算法遵循均值最近邻原则保留权重:

将 中与集合

中与集合 对应的权重固定在模型中,作为学习任务t 的知识沉淀。算法将模型中其余的权重屏蔽,设置它们为零。当网络中部分权重突然被屏蔽设置为零后,会导致权重矩阵稀疏,网络的连通性随之改变,识别精度下降。为了恢复网络性能,需要使用较少的轮次对网络进行微调训练。

对应的权重固定在模型中,作为学习任务t 的知识沉淀。算法将模型中其余的权重屏蔽,设置它们为零。当网络中部分权重突然被屏蔽设置为零后,会导致权重矩阵稀疏,网络的连通性随之改变,识别精度下降。为了恢复网络性能,需要使用较少的轮次对网络进行微调训练。

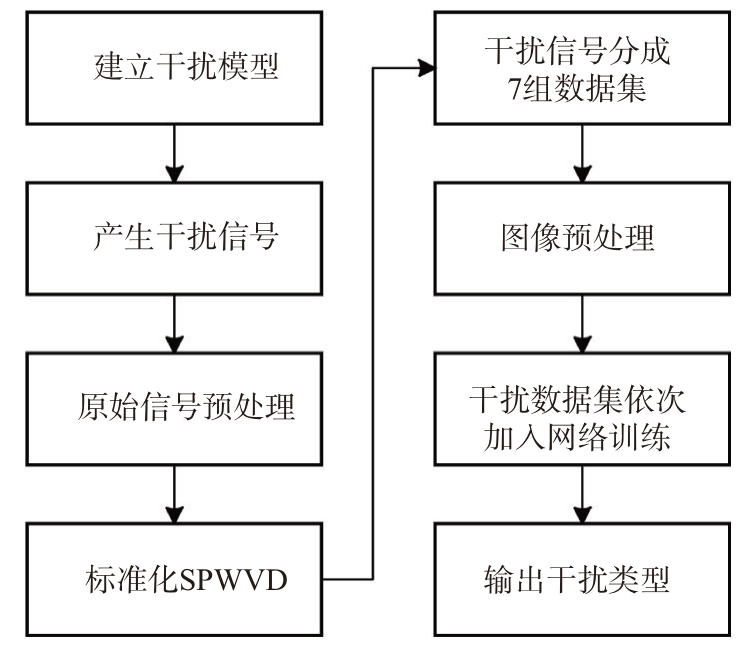

整体的干扰识别流程如图1所示,首先对目标回波和干扰信号进行建模,在信号上叠加高斯白噪声,仿真产生干扰信号;然后将一个脉冲重复周期内的信号作为原始数据进行预处理,处理过程包括取均值化与方差标准化、图像宽高比归一化和均值滤波;之后进行标准化SPWVD 变换生成适合CNN处理的二维图像;然后将包含干扰和目标回波信号在内的7种雷达信号类型,进行输入CNN前的图像预处理;最后建立干扰识别网络模型,依次加入7组数据集进行训练,得到输出的干扰类型。

图1 整体干扰识别流程图

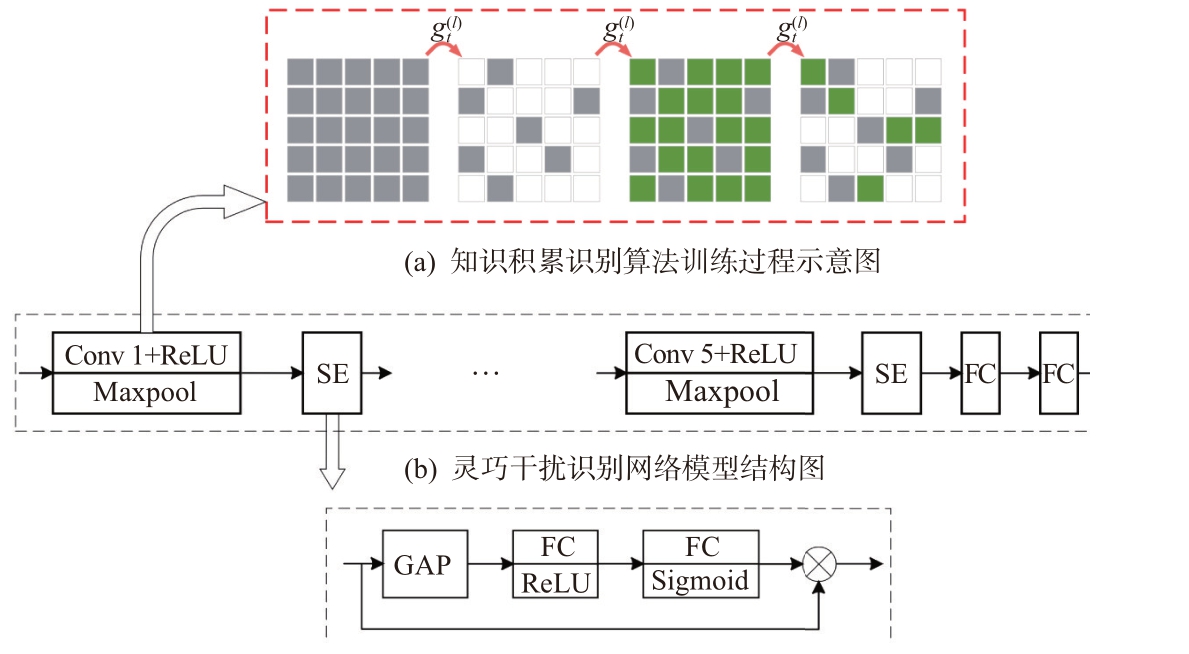

本文提出的知识积累与灵巧干扰识别网络模型的整体结构如图2(b)所示,模型整体采用VGG-16[21]结构作为基础,在每个最大池化层后加入SE注意力模块,提升模型的特征提取能力。图中Conv和FC代表卷积层和全连接层,SE代表注意力模块。

图2 知识积累与灵巧干扰识别网络模型

为了在网络获取信号图像特征后,加强干扰部分的特征,淡化噪声部分的特征,进一步提升网络识别准确率,算法使用特征通道注意力机制增强获取特征中的有效成分。本文算法中在基础模型的每个最大池化层后加入通道注意力(Squeezeand-Excitation, SE)模块[22],其结构如图2(c)所示,其中GAP(Global Average Pooling)代表全局平均池化层。来自上一层最大池化层的输出在经过注意力模块中的全局平均池化层后,得到输出z=(z1,z2,…,zC)T,其中C为网络中数据的特征通道数。之后,z 通过降维的全连接层和激活函数ReLU 与升维的全连接层和激活函数Sigmoid 后,得到注意力模块的输出![]() 计算公式为

计算公式为

式中W1=(wij)(C/r)×C,W2=(wij)C ×(C/r)代表两个全连接层的权重参数矩阵,r 为衰减因子,在算法中设置为16,σ(·)为Sigmoid函数,δ(·)为ReLU函数。

知识积累干扰识别算法的主要训练流程如图2(a)所示,灰色代表固定在网络中的权重参数,白色表示算法将权重设置为零,绿色表示网络中用于另一分类任务的权重。

第一步:使用预训练过的网络模型在任务1训练,得到全灰色网络,算法按照均值最近邻策略固定权重后,将其他权重设置为零,得到任务1 的最终网络权重矩阵。

第二步:当模型学习新的任务2 时,网络中所有参数均参与训练,灰色权重保持不变,白色权重被绿色填充,得到任务2的初始网络。此时根据算法屏蔽只属于任务2 的绿色权重,得到任务2 的最终网络权重矩阵。

第三步:为了在权重屏蔽后恢复网络性能,对网络进行微调。

之后重复以上过程,干扰识别网络可以不断学习和积累知识。

2 仿真实验与结果分析

2.1 数据集与实验设置

本文算法模型首先在数据集ImageNet-1K[23]上进行初始网络的训练,获取初始化权重,规避模型梯度消失或爆炸的风险,并且缩短训练时间。

仿真生成干扰时,通过改变干扰信号的相关参数,构建的数据集可以更好地保证算法的泛化性和稳定性。

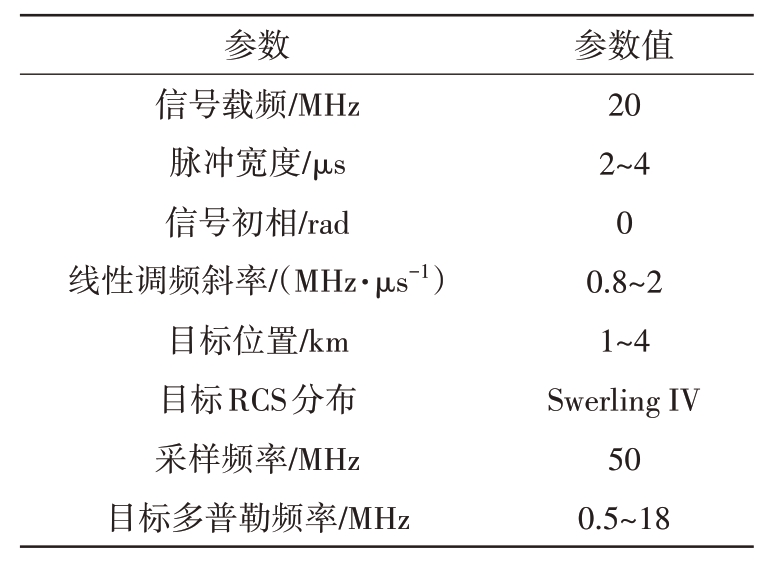

仿真时,针对包含无干扰的目标回波信号和6种灵巧干扰信号,加入高斯白噪声,生成信噪比(SNR)在-10~20 dB,干信比(JSR)在5~20 dB 范围,切片宽度为0.5~2.5µs,切片数量为2~6的样本集。其他信号生成过程的参数设置如表1所示。

表1 干扰信号参数设置

参数值20 2~4 0 0.8~2 1~4 Swerling IV 50 0.5~18参数信号载频/MHz脉冲宽度/µs信号初相/rad线性调频斜率/(MHz·µs-1)目标位置/km目标RCS分布采样频率/MHz目标多普勒频率/MHz

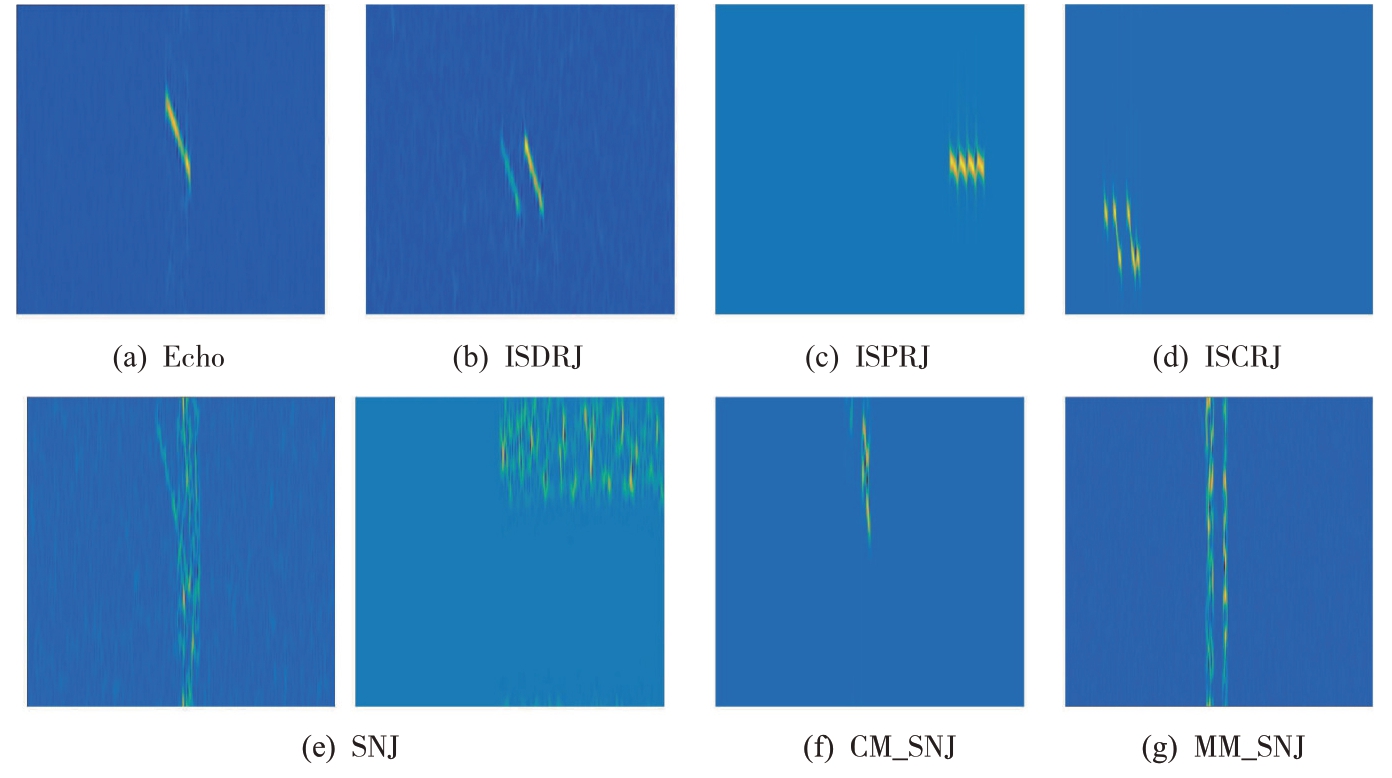

数据集中一共包含7 种雷达信号类型的SPWVD 图像,7 种灵巧干扰数据集的SPWVD 图像示例如图3 所示,分别是:无干扰的真实目标回波信号(Echo),ISDRJ,ISPRJ,ISCRJ,SNJ,CM_SNJ,MM_SNJ。

图3 7种雷达干扰的时频图像示例

SNJ 的图像示例包含卷积调制和乘积调制两种干扰类型。每种信号的训练集样本数为500,验证集样本数为150。训练集总样本数为3 500,验证集总样本数为1 050。

本文算法采用Pytorch 深度学习框架实现,在网络训练和测试阶段,将所有数据集的输入图像的尺寸统一调整为224×224。在训练阶段,算法使用随机裁剪和随机水平翻转进行数据增广。7 种干扰信号的数据集依次加入模型中进行训练,模型首先在初始任务上训练20 个轮次,初始学习率为10-4,每训练迭代10 个轮次后,学习率衰减10倍。之后分层屏蔽网络中80%的权重,进行网络的微调,学习率为10-3,每训练迭代5 个轮次,衰减10 倍。参数更新优化器选择Adam 算法,batchsize设置为32。之后每新增一个干扰信号类型加入网络中进行训练时,重复以上过程,并在模型中添加一个新的输出层。

为了对比性能,本文中选择并复现了3种基线模型:VGG-16[21]、ResNet-18[24]、S-CNN[9]。基线模型均使用原论文中推荐的方法和参数进行训练,均在ImageNet-1K上进行了预训练。

2.2 模型多项任务平均识别准确率

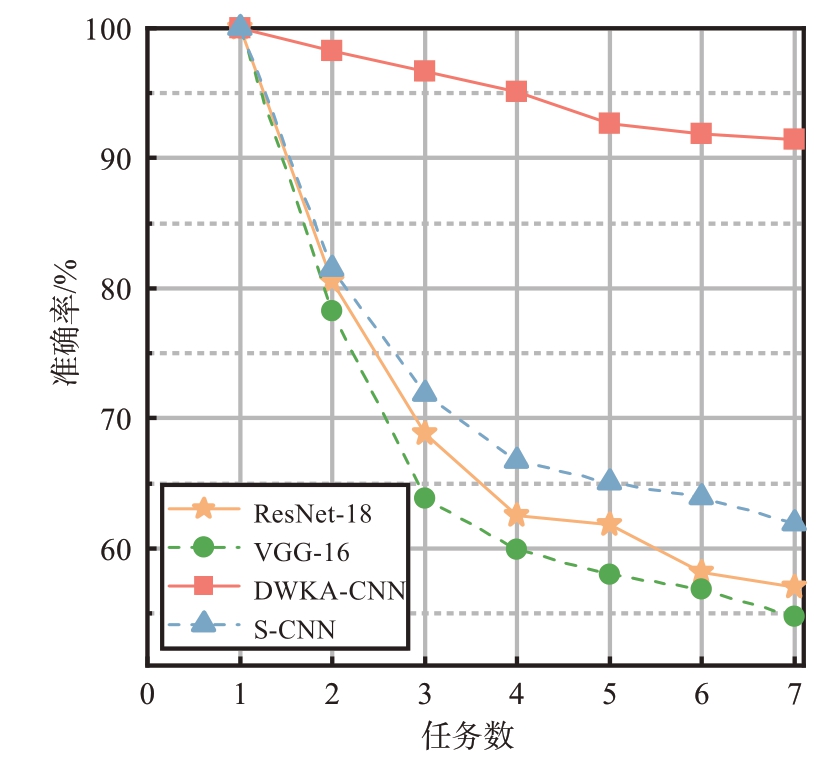

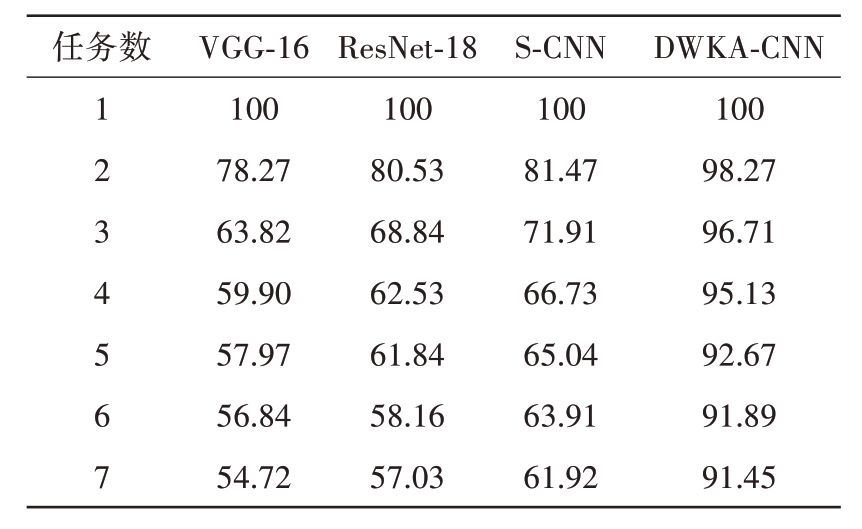

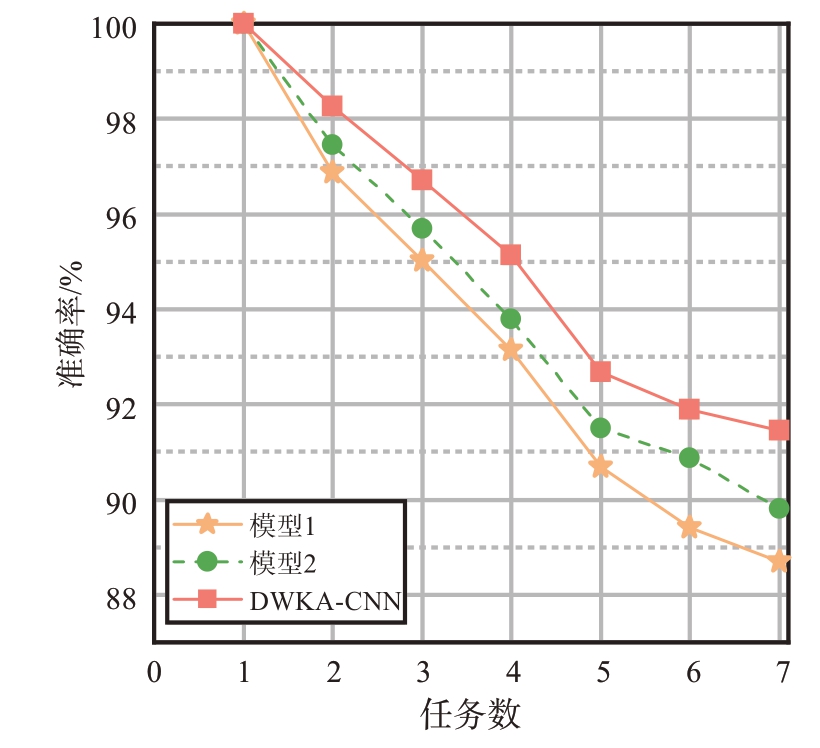

为了验证模型在单一网络中学习多项干扰识别任务的性能,实验中,设计依次向网络中增加7种类型的信号数据集进行训练。数据集加入的顺序为:ISDRJ、Echo、SNJ、ISCRJ、CM_SNJ、ISPRJ、MM_SNJ。在每次任务学习完成后,计算所有已完成学习的干扰任务的平均识别准确率。得到每种模型的对比结果如图4 所示。图中的准确率是实验独立运行5 次的平均值,其中DWKA-CNN 为本文算法模型。

图4 不同模型多项干扰任务平均识别准确率对比

图4 显示,在分步将7 种灵巧干扰识别任务加入网络的过程中,由于3种基线模型中没有用于知识积累的模块,当新的干扰识别任务加入网络后,在之前任务上的识别准确率会大幅下降,从而影响平均识别准确率。在整个实验过程中,本文算法模型的平均识别准确率没有明显地下降,总是高于其他网络模型。表2 总结了4 种算法模型的Top-1平均识别准确率。

表2 不同模型的Top-1平均识别准确率

任务数1234567 VGG-16 100 78.27 63.82 59.90 57.97 56.84 54.72 ResNet-18 100 80.53 68.84 62.53 61.84 58.16 57.03 S-CNN 100 81.47 71.91 66.73 65.04 63.91 61.92 DWKA-CNN 100 98.27 96.71 95.13 92.67 91.89 91.45

表2 显示,VGG-16、ResNet-18 和S-CNN 3 个模型在第2个干扰识别任务加入后,平均识别准确率分别下降到78.27%、80.53%和81.47%,在第4个干扰识别任务加入后,平均识别准确率分别下降到59.90%、62.53%和66.73%,最终的平均识别准确率为54.72%、57.03%和61.92%。而本文算法模型在第7个干扰识别任务加入后,最终的平均识别准确率为91.45%。当新任务加入DWKA-CNN 模型时,只需要训练新加入的数据集,无需将之前学习过的所有数据集加起来重新训练,缩短了总训练时长,实现了在单一网络中学习多项干扰识别任务的目标。

2.3 模型整体平均识别准确率

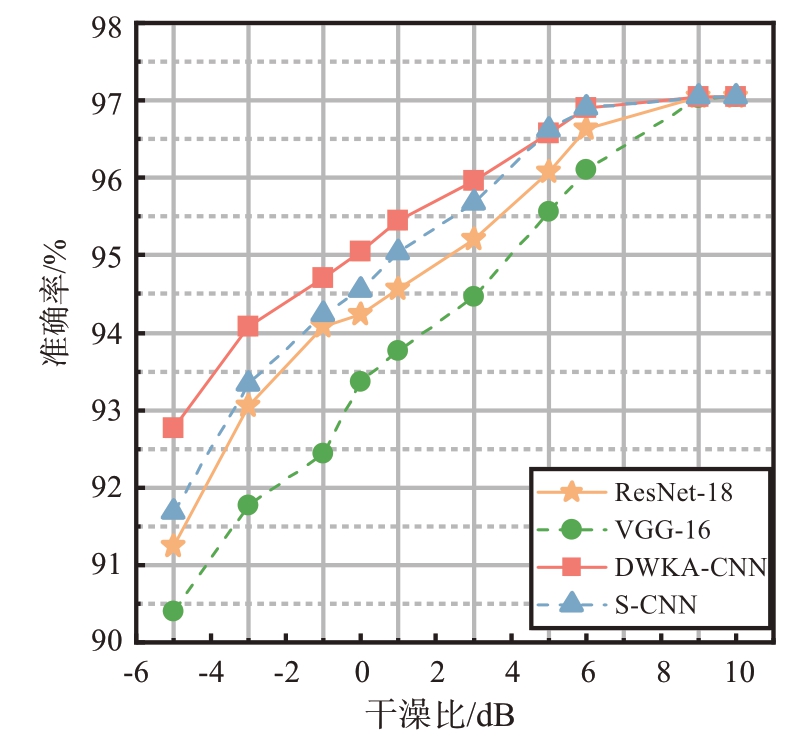

为了研究算法模型对灵巧干扰的整体干扰识别能力和在低干噪比下识别性能,本文在仿真生成干扰信号时,固定JSR=5 dB,改变JNR 的数值,实验中纪录不同模型所有测试样本的整体识别准确率。每个JNR 条件下,每种灵巧干扰生成650张时频二维图,随机拆分为训练集500 张和测试集150 张。图5 显示了4 种网络模型在不同干噪比下的整体平均识别准确率。图中的准确率是实验独立运行5次的平均值。

图5 不同干噪比下各模型整体平均识别准确率变化

图5显示,本文算法整体干扰识别性能更为稳定和准确。本文算法在较低干噪比条件下,相较于其余3 种模型识别准确率更高;在JNR≥9 dB 后,本文算法与其余3 种模型识别准确率没有明显差距。由此可见,本文算法模型在干噪比发生变化时,识别准确率更为稳定,且在低信噪比时表现优秀,拥有更好的干扰识别性能。

2.4 消融实验

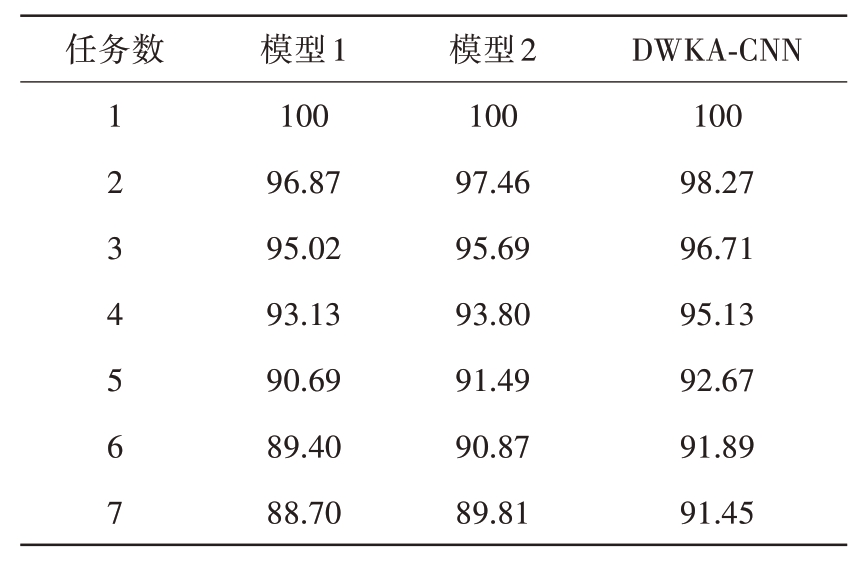

为了进一步验证本文算法模块的有效性,分离模型中的改进模块,进行了消融实验。本节实验中构建了两种不同的模型。模型1 与原模型DWKA-CNN 相比,不采用均值最近邻策略保留权重,而将网络中动态变化的权重按绝对值大小排序,然后保留网络中一定百分比绝对值较大的权重;模型2 与DWKA-CNN 模型相比,在网络中不加入SE 模块。重做2.2 节中的实验,对比结果如图6所示。

图6 DWKA-CNN模型修改后识别准确率变化

图6显示,采用均值最近邻策略保留权重和在网络中加入注意力模块能够明显提升模型的识别准确率。模型1 与模型2 和DWKA-CNN 的比较显示,采用均值最近邻策略保留网络中的权重对提升识别准确率更为有效。实验中得到表3的Top-1平均识别准确率,结果均为实验独立运行5次的平均值。

表3 修改DWKA-CNN模型的Top-1平均识别准确率

任务数1234567模型1 100 96.87 95.02 93.13 90.69 89.40 88.70模型2 100 97.46 95.69 93.80 91.49 90.87 89.81 DWKA-CNN 100 98.27 96.71 95.13 92.67 91.89 91.45

表3 显示,模型1 和模型2 在第2 个干扰任务加入后,识别准确率较原模型下降1.40% 和0.81%,最终第7个干扰任务加入后,识别准确率较原模型下降2.75%和1.64%。

3 结束语

本文针对复杂动态电磁环境下,新式灵巧干扰分类问题中识别网络收敛能力较差,低干噪比下准确率较低的问题,提出了一种新的基于动态权重的知识积累与灵巧干扰识别方法,通过将干扰信号的SPWVD 图像作为CNN 的输入,在网络每次进行识别的过程中,结合均值最近邻原则分层屏蔽权重,在训练过程中完成了知识的积累,在新的干扰对抗情景中,模型无需每次重新训练。并且利用通道特征注意力机制,联合提升了模型的干扰识别能力。在仿真生成的7 种雷达干扰数据集上的实验验证表明:与现有算法相比,在低信噪比条件下整体干扰识别准确率提升显著。

基于目前的工作,下一步的研究方向是,进一步优化算法性能和压缩网络,扩大网络可容纳的任务数量,使得提出的算法模型实现在存储权限和设备的内存大小受到限制的真实场景下的部署。

[1]LIU Zhen, SUI Jinping, WEI Zhenhua, et al. A Sparse-Driven Anti-Velocity Deception Jamming Strategy Based on Pulse-Doppler Radar with Random Pulse Initial Phases[J].Sensors,2018,18(4):1249.

[2]LU Lu,GAO Meiguo.An Improved Sliding Matched Filter Method for Interrupted Sampling Repeater Jamming Suppression Based on Jamming Reconstruction[J].IEEE Sensors Journal,2022,22(10):9675-9684.

[3]ZHANG Yang, WEI Yinsheng, YU Lei. Interrupted Sampling Repeater Jamming Recognition and Suppression Based on Phase-Coded Signal Processing[J]. Signal Processing,2022,198:108596.

[4]XI Rongyan, MA Dingyou, LIU Xiang, et al. Intra-Pulse Frequency Coding Design for a High-Resolution Radar Against Smart Noise Jamming[J]. Remote Sensing, 2022,14(20):5149.

[5]周红平,王子伟,郭忠义.雷达有源干扰识别算法综述[J].数据采集与处理,2022,37(1):1-20.

[6]HE Kaiming, CHEN Xinlei, XIE Saining, et al. Masked Autoencoders are Scalable Vision Learners[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition,New Orleans, LA, USA:IEEE,2022:15979-15988.

[7]ZHANG Hao, LI Feng, LIU Shilong, et al. Dino: Detr with Improved Denoising Anchor Boxes for End-to-End Object Detection[J]. arXiv, 2022. https://doi.org/10.48550/arXiv.2203.03605.

[8]郭治锐,鲁军,刘磊,等.基于AlexNet 的雷达干扰识别方法研究[J].电光与控制,2021,28(9):49-53.

[9]SHAO Guangqing,CHEN Yushi,WEI Yinsheng.Convolutional Neural Network-Based Radar Jamming Signal Classification with Sufficient and Limited Samples[J]. IEEE Access,2020,8:80588-80598.

[10]王鹏宇,程郁凡,徐昊,等.基于卷积神经网络联合多域特征提取的干扰识别算法[J].信号处理,2022,38(5):915-925.

[11]唐陈,王峰.基于卷积神经网络的雷达干扰识别技术研究[J].中国电子科学研究院学报,2022,17(1):63-70.

[12]刘国满,聂旭娜.一种基于卷积神经网络的雷达干扰识别算法[J].北京理工大学学报,2021,41(9):990-998.

[13]ZHU Hairui, GUO Shanhong, SHENG Weixing. RDJCNN: A Micro-Convolutional Neural Network for Radar Active Jamming Signal Classification[J].Engineering Applications of Artificial Intelligence,2023,123:106417.

[14]LUO Zhenyu,CAO Yunhe,YEO T S,et al.Few-Shot Radar Jamming Recognition Network via Time-Frequency Self-Attention and Global Knowledge Distillation[J].IEEE Trans on Geoscience and Remote Sensing, 2023,61:5105612.

[15]LV Qinzhe,QUAN Yinghui,FENG Wei,et al.Radar Deception Jamming Recognition Based on Weighted Ensemble CNN with Transfer Learning[J]. IEEE Trans on Geoscience and Remote Sensing,2021,59:1-11.

[16]KHAN N A, SANDSTEN M. Time-Frequency Image Enhancement Based on Interference Suppression in Wigner-Ville Distribution[J].Signal Processing,2016,127:80-85.

[17]KALRA M, KUMAR S, DAS B. Target Detection Using Smooth Pseudo Wigner-Ville Distribution[C]//2018 IEEE Recent Advances in Intelligent Computational Systems,Thiruvananthapuram,India:IEEE,2018:6-10.

[18]TAN Mingxing, LE Q. Efficientnetv2: Smaller Models and Faster Training[C]// Proceedings of the 38th International Conference on Machine Learning,[S.l.]:PMLR,2021:10096-10106.

[19] MALLYA A, DAVIS D, LAZEBNIK S. Piggyback:Adapting a Single Network to Multiple Tasks by Learning to Mask Weights[C]// Proceedings of the European Conference on Computer Vision,Munich,Germany:[s.n.],2018:72-88.

[20]TANAKA H, KUNIN D, YAMINS D L, et al. Pruning Neural Networks Without Any Data by Iteratively Conserving Synaptic Flow[J]. Advances in Neural Information Processing Systems,2020,33:6377-6389.

[21]SIMONYAN K,ZISSERMAN A.Very Deep Convolutional Networks for Large-Scale Image Recognition[J]. arXiv,2014.https://doi.org/10.48550/arXiv.1409.1556.

[22]WANG Xiaobing, JIANG Yingying, LUO Zhenbo, et al.Arbitrary Shape Scene Text Detection with Adaptive Text Region Representation[C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition,Long Beach,CA,USA:IEEE,2019:6449-6458.

[23]RUSSAKOVSKY O, DENG Jia, SU Hao, et al. Imagenet Large Scale Visual Recognition Challenge[J]. International Journal of Computer Vision,2015,115:211-252.

[24]HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al.Deep Residual Learning for Image Recognition[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,Las Vegas,NV,USA:IEEE,2016:770-778.